DeepSeek-V2:一种强大、经济且高效的混合专家语言模型

DeepSeek-AI research@deepseek.com

摘要

我们提出了 DeepSeek-V2,这是一种强大的混合专家(MoE)语言模型,其特点是训练经济且推理高效。它总共包含 236B 个参数,其中每个 token 激活 21B 个参数,并支持 128K token 的上下文长度。DeepSeek-V2 采用了包括多头潜在注意力(Multi-head Latent Attention, MLA)和 DeepSeekMoE 在内的创新架构。MLA 通过将键值(KV)缓存显著压缩为潜在向量,保证了高效的推理;而 DeepSeekMoE 则通过稀疏计算,以经济的成本训练出强大的模型。与 DeepSeek 67B 相比,DeepSeek-V2 在性能上显著增强,同时节省了 42.5% 的训练成本,将 KV 缓存减少了 93.3%,并将最大生成吞吐量提升至 5.76 倍。我们在由 8.1T token 组成的高质量多源语料库上对 DeepSeek-V2 进行了预训练,并进一步执行了监督微调(SFT)和强化学习(RL)以充分释放其潜力。评估结果表明,即使仅激活 21B 个参数,DeepSeek-V2 及其聊天版本在开源模型中仍能达到顶级性能。模型检查点可在 https://github.com/deepseek-ai/DeepSeek-V2 获取。

目录

- 引言 4

- 架构 6 2.1 多头潜在注意力:提升推理效率 6 2.1.1 预备知识:标准多头注意力 6 2.1.2 低秩键值联合压缩 7 2.1.3 解耦旋转位置编码 8 2.1.4 键值缓存对比 8 2.2 DeepSeekMoE:以经济成本训练强大模型 9 2.2.1 基础架构 9 2.2.2 设备受限路由 9 2.2.3 负载均衡辅助损失 10 2.2.4 Token 丢弃策略 11

- 预训练 11 3.1 实验设置 11 3.1.1 数据构建 11 3.1.2 超参数 12 3.1.3 基础设施 12 3.1.4 长上下文扩展 13 3.2 评估 13 3.2.1 评估基准 13 3.2.2 评估结果 14 3.2.3 训练和推理效率 16

- 对齐 16 4.1 监督微调 16 4.2 强化学习 17 4.3 评估结果 18 4.4 讨论 20

- 结论、局限性与未来工作 21 A. 贡献与致谢 27 B. DeepSeek-V2-Lite:配备 MLA 和 DeepSeekMoE 的 16B 模型 29 B.1 模型描述 29 B.2 性能评估 30 C. MLA 的完整公式 31 D. 注意力机制消融实验 31 D.1 MHA、GQA 和 MQA 的消融 31 D.2 MLA 与 MHA 的对比 31 E. 关于预训练数据去偏的讨论 32 F. 数学和代码的额外评估 32 G. 评估格式 33

1. 引言

在过去的几年里,大型语言模型(LLMs)(Anthropic, 2023; Google, 2023; OpenAI, 2022, 2023)经历了快速发展,让我们得以一窥通用人工智能(AGI)的曙光。通常,LLM 的智能随着参数数量的增加而提高,使其能够在各种任务中展现出涌现能力(Wei et al., 2022)。然而,这种提升是以更大的训练计算资源和潜在的推理吞吐量下降为代价的。这些限制对 LLM 的广泛采用和利用构成了重大挑战。为了解决这个问题,我们引入了 DeepSeek-V2,这是一种强大的开源混合专家(MoE)语言模型,通过创新的 Transformer 架构实现了经济的训练和高效的推理。它总共配备了 236B 个参数,其中每个 token 激活 21B 个参数,并支持 128K token 的上下文长度。

我们利用我们提出的多头潜在注意力(MLA)和 DeepSeekMoE 优化了 Transformer 框架(Vaswani et al., 2017)中的注意力模块和前馈网络(FFNs)。(1) 在注意力机制方面,多头注意力(MHA)(Vaswani et al., 2017)的键值(KV)缓存对 LLM 的推理效率构成了重大障碍。为了解决这个问题,人们探索了各种方法,包括分组查询注意力(GQA)(Ainslie et al., 2023)和多查询注意力(MQA)(Shazeer, 2019)。然而,这些方法在试图减少 KV 缓存时往往会牺牲性能。为了兼顾两者,我们引入了 MLA,这是一种配备了低秩键值联合压缩的注意力机制。从经验上看,MLA 在性能上优于 MHA,同时在推理过程中显著减少了 KV 缓存,从而提高了推理效率。(2) 对于前馈网络(FFNs),我们遵循 DeepSeekMoE 架构(Dai et al., 2024),该架构采用细粒度的专家分割和共享专家隔离,以实现更高的专家专业化潜力。与 GShard(Lepikhin et al., 2021)等传统 MoE 架构相比,DeepSeekMoE 架构展现出了巨大的优势,使我们能够以经济的成本训练强大的模型。由于我们在训练中采用了专家并行,我们还设计了辅助机制来控制通信开销并确保负载均衡。通过结合这两种技术,DeepSeek-V2 同时具备了强大的性能(图 1(a))、经济的训练成本和高效的推理吞吐量(图 1(b))。

我们构建了一个由 8.1T token 组成的高质量多源预训练语料库。与 DeepSeek 67B(我们之前的版本)(DeepSeek-AI, 2024)中使用的语料库相比,该语料库具有更多的数据量,特别是中文数据,且数据质量更高。我们首先在完整的预训练语料库上对 DeepSeek-V2 进行预训练。然后,我们收集了 1.5M 个对话会话,涵盖数学、代码、写作、推理、安全等多个领域,对 DeepSeek-V2 Chat (SFT) 进行监督微调。最后,我们遵循 DeepSeekMath(Shao et al., 2024)的方法,采用组相对策略优化(GRPO)进一步将模型与人类偏好对齐,从而产生 DeepSeek-V2 Chat (RL)。

我们在广泛的英语和中文基准测试上评估了 DeepSeek-V2,并将其与代表性的开源模型进行了比较。评估结果表明,即使仅激活 21B 个参数,DeepSeek-V2 在开源模型中仍能达到顶级性能,并成为最强的开源 MoE 语言模型。图 1(a) 强调了在 MMLU 上,DeepSeek-V2 仅用少量的激活参数就实现了顶级的性能。此外,如图 1(b) 所示,与 DeepSeek 67B 相比,DeepSeek-V2 节省了 42.5% 的训练成本,将 KV 缓存减少了 93.3%,并将最大生成吞吐量提升至 5.76 倍。我们还评估了 DeepSeek-V2 Chat (SFT) 和 DeepSeek-V2 Chat (RL) 在开放式基准测试上的表现。值得注意的是,DeepSeek-V2 Chat (RL) 在 AlpacaEval 2.0(Dubois et al., 2024)上达到了 38.9 的长度控制胜率,在 MT-Bench(Zheng et al., 2023)上获得了 8.97 的总分,在 AlignBench(Liu et al., 2023)上获得了 7.91 的总分。英语开放式对话评估表明,DeepSeek-V2 Chat (RL) 在开源聊天模型中具有顶级性能。此外,AlignBench 的评估表明,在中文方面,DeepSeek-V2 Chat (RL) 优于所有开源模型,甚至击败了大多数闭源模型。

为了促进对 MLA 和 DeepSeekMoE 的进一步研究和开发,我们还向开源社区发布了 DeepSeek-V2-Lite,这是一个配备了 MLA 和 DeepSeekMoE 的较小模型。它总共有 15.7B 个参数,其中每个 token 激活 2.4B 个参数。关于 DeepSeek-V2-Lite 的详细描述可以在附录 B 中找到。

在本文的其余部分,我们首先详细描述了 DeepSeek-V2 的模型架构(第 2 节)。随后,我们介绍了我们的预训练工作,包括训练数据构建、超参数设置、基础设施、长上下文扩展以及模型性能和效率的评估(第 3 节)。在此之后,我们展示了我们在对齐方面的努力,包括监督微调(SFT)、强化学习(RL)、评估结果以及其他讨论(第 4 节)。最后,我们总结了结论,审视了 DeepSeek-V2 目前的局限性,并概述了我们未来的工作(第 5 节)。

2. 架构

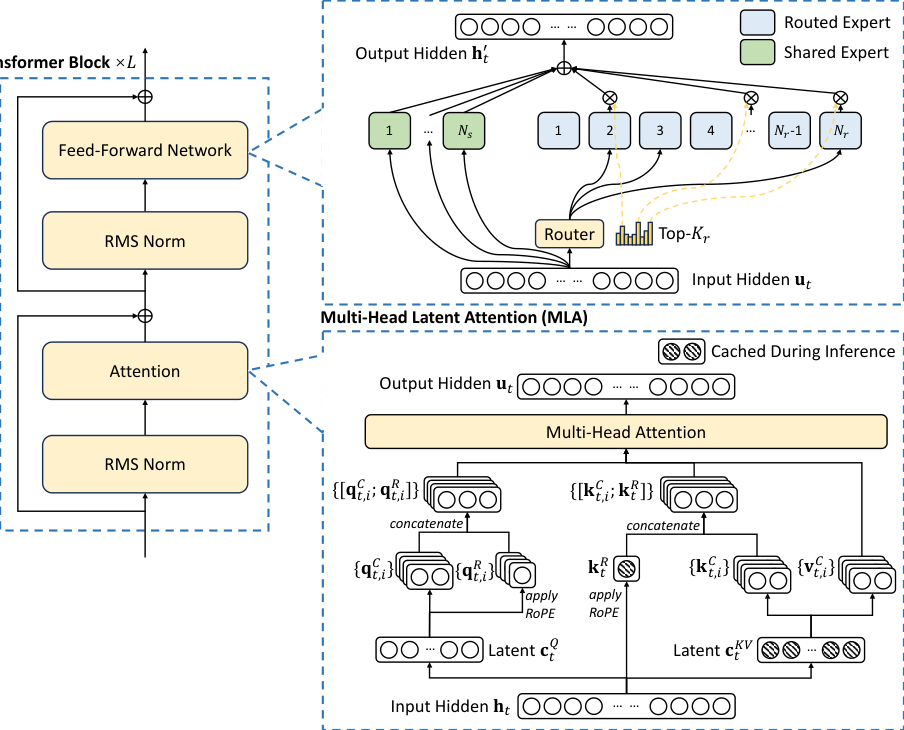

总的来说,DeepSeek-V2 仍然采用 Transformer 架构(Vaswani et al., 2017),其中每个 Transformer 块由一个注意力模块和一个前馈网络(FFN)组成。然而,对于注意力模块和 FFN,我们设计并采用了创新的架构。对于注意力,我们设计了 MLA,它利用低秩键值联合压缩来消除推理时键值缓存的瓶颈,从而支持高效推理。对于 FFN,我们采用了 DeepSeekMoE 架构(Dai et al., 2024),这是一种高性能的 MoE 架构,能够以经济的成本训练强大的模型。DeepSeek-V2 的架构示意图如图 2 所示,我们将在本节中介绍 MLA 和 DeepSeekMoE 的细节。对于其他微小细节(例如 FFN 中的层归一化和激活函数),除非特别说明,DeepSeek-V2 遵循 DeepSeek 67B(DeepSeek-AI, 2024)的设置。

2.1. 多头潜在注意力:提升推理效率

传统的 Transformer 模型通常采用多头注意力(MHA)(Vaswani et al., 2017),但在生成过程中,其沉重的键值(KV)缓存将成为限制推理效率的瓶颈。为了减少 KV 缓存,人们提出了多查询注意力(MQA)(Shazeer, 2019)和分组查询注意力(GQA)(Ainslie et al., 2023)。它们需要较小规模的 KV 缓存,但其性能无法与 MHA 匹敌(我们在附录 D.1 中提供了 MHA、GQA 和 MQA 的消融实验)。

对于 DeepSeek-V2,我们设计了一种名为多头潜在注意力(MLA)的创新注意力机制。配备了低秩键值联合压缩,MLA 实现了比 MHA 更好的性能,但所需的 KV 缓存量显著减少。我们在下文中介绍了其架构,并在附录 D.2 中提供了 MLA 和 MHA 的对比。

2.1.1. 预备知识:标准多头注意力

我们首先介绍标准 MHA 机制作为背景。设 为嵌入维度, 为注意力头数, 为每个头的维度, 为注意力层中第 个 token 的注意力输入。标准 MHA 首先通过三个矩阵 分别产生 :

\mathbf{q}_t = \mathbf{W}^Q \mathbf{h}_t, \tag{1} \mathbf{k}_t = \mathbf{W}^K \mathbf{h}_t, \tag{2} \mathbf{v}_t = \mathbf{W}^V \mathbf{h}_t, \tag{3}

然后, 将被切片为 个头,用于多头注意力计算:

[\mathbf{q}_{t,1}; \mathbf{q}_{t,2}; \dots; \mathbf{q}_{t,n_h}] = \mathbf{q}_t, \tag{4} [\mathbf{k}_{t,1}; \mathbf{k}_{t,2}; \dots; \mathbf{k}_{t,n_h}] = \mathbf{k}_t, \tag{5} [\mathbf{v}_{t,1}; \mathbf{v}_{t,2}; \dots; \mathbf{v}_{t,n_h}] = \mathbf{v}_t, \tag{6} \mathbf{o}_{t,i} = \sum_{j=1}^t \text{Softmax}_j \left( \frac{\mathbf{q}_{t,i} \mathbf{k}_{j,i}^\top}{\sqrt{d_h}} \right) \mathbf{v}_{j,i}, \tag{7} \mathbf{u}_t = \mathbf{W}^O [\mathbf{o}_{t,1}; \mathbf{o}_{t,2}; \dots; \mathbf{o}_{t,n_h}], \tag{8}

其中 分别表示第 个注意力头的查询、键和值; 表示输出投影矩阵。在推理过程中,所有键和值都需要被缓存以加速推理,因此 MHA 需要为每个 token 缓存 个元素。在模型部署中,这种沉重的 KV 缓存是一个巨大的瓶颈,限制了最大批处理大小和序列长度。

2.1.2. 低秩键值联合压缩

MLA 的核心是用于键和值的低秩联合压缩,以减少 KV 缓存:

\mathbf{c}_t^{KV} = \mathbf{W}^{DKV} \mathbf{h}_t, \tag{9} \mathbf{k}_t^{KV} = \mathbf{W}^{UK} \mathbf{c}_t^{KV}, \tag{10} \mathbf{v}_t^{KV} = \mathbf{W}^{UV} \mathbf{c}_t^{KV}, \tag{11}

其中 是用于键和值的压缩潜在向量; 表示 KV 压缩维度; 是下投影矩阵; 分别是键和值的上投影矩阵。在推理过程中,MLA 只需要缓存 ,因此其 KV 缓存仅有 个元素,其中 表示层数。此外,在推理过程中,由于 可以被吸收到 中,而 可以被吸收到 中,我们甚至不需要计算出用于注意力的键和值。图 3 直观地说明了 MLA 中的 KV 联合压缩如何减少 KV 缓存。

此外,为了减少训练期间的激活内存,我们还执行了查询的低秩压缩,即使它不能减少 KV 缓存:

\mathbf{c}_t^Q = \mathbf{W}^{DQ} \mathbf{h}_t, \tag{12} \mathbf{q}_t^C = \mathbf{W}^{UQ} \mathbf{c}_t^Q, \tag{13}

其中 是用于查询的压缩潜在向量; 表示查询压缩维度; 分别是查询的下投影和上投影矩阵。

2.1.3. 解耦旋转位置编码

遵循 DeepSeek 67B(DeepSeek-AI, 2024),我们打算在 DeepSeek-V2 中使用旋转位置编码(RoPE)(Su et al., 2024)。然而,RoPE 与低秩 KV 压缩不兼容。具体来说,RoPE 对于键和查询都是位置敏感的。如果我们对键 应用 RoPE,公式 10 中的 将与位置敏感的 RoPE 矩阵耦合。这样,在推理过程中 就不能再被吸收到 中,因为与当前生成 token 相关的 RoPE 矩阵将位于 和 之间,且矩阵乘法不满足交换律。结果,我们必须在推理过程中重新计算所有前缀 token 的键,这将显著阻碍推理效率。

作为解决方案,我们提出了解耦 RoPE 策略,该策略使用额外的多头查询 和共享键 来携带 RoPE,其中 表示解耦查询和键的每头维度。配备了解耦 RoPE 策略,MLA 执行以下计算:

[\mathbf{q}_{t,1}^R; \mathbf{q}_{t,2}^R; \dots; \mathbf{q}_{t,n_h}^R] = \mathbf{q}_t^R = \text{RoPE}(\mathbf{W}^{QR} \mathbf{c}_t^Q), \tag{14} \mathbf{k}_t^R = \text{RoPE}(\mathbf{W}^{KR} \mathbf{h}_t), \tag{15} \mathbf{q}_{t,i} = [\mathbf{q}_{t,i}^C; \mathbf{q}_{t,i}^R], \tag{16} \mathbf{k}_{t,i} = [\mathbf{k}_{t,i}^C; \mathbf{k}_t^R], \tag{17} \mathbf{o}_{t,i} = \sum_{j=1}^t \text{Softmax}_j \left( \frac{\mathbf{q}_{t,i} \mathbf{k}_{j,i}^\top}{\sqrt{d_h + d_h^R}} \right) \mathbf{v}_{t,i}^C, \tag{18} \mathbf{u}_t = \mathbf{W}^O [\mathbf{o}_{t,1}; \mathbf{o}_{t,2}; \dots; \mathbf{o}_{t,n_h}], \tag{19}

其中 和 分别是产生解耦查询和键的矩阵; 表示应用 RoPE 矩阵的操作; 表示拼接操作。在推理过程中,解耦键也应该被缓存。因此,DeepSeek-V2 需要总共包含 个元素的 KV 缓存。

为了演示 MLA 的完整计算过程,我们还在附录 C 中整理并提供了其完整公式。

2.1.4. 键值缓存对比

我们在表 1 中展示了不同注意力机制下每个 token 的 KV 缓存对比。MLA 仅需要少量的 KV 缓存,等同于仅有 2.25 个组的 GQA,但可以实现比 MHA 更强的性能。

| 注意力机制 | 每个 Token 的 KV 缓存(元素数量) | 能力 |

|---|---|---|

| 多头注意力(MHA) | 强 | |

| 分组查询注意力(GQA) | 中等 | |

| 多查询注意力(MQA) | 弱 | |

| MLA(我们) | 更强 |

表 1 | 不同注意力机制下每个 token 的 KV 缓存对比。 表示注意力头数, 表示每个注意力头的维度, 表示层数, 表示 GQA 中的组数, 和 分别表示 MLA 中 KV 压缩维度和解耦查询与键的每头维度。KV 缓存量以元素数量衡量,与存储精度无关。对于 DeepSeek-V2, 设置为 , 设置为 。因此,其 KV 缓存等同于仅有 2.25 个组的 GQA,但其性能比 MHA 更强。

2.2. DeepSeekMoE:以经济成本训练强大模型

2.2.1. 基础架构

对于 FFN,我们采用了 DeepSeekMoE 架构(Dai et al., 2024)。DeepSeekMoE 有两个关键思想:将专家细分为更细的粒度以实现更高的专家专业化和更准确的知识获取,并隔离一些共享专家以减轻路由专家之间的知识冗余。在激活专家参数和总专家参数数量相同的情况下,DeepSeekMoE 可以以很大的优势超越 GShard(Lepikhin et al., 2021)等传统 MoE 架构。

设 为第 个 token 的 FFN 输入,我们计算 FFN 输出 如下:

\mathbf{h}_t' = \mathbf{u}_t + \sum_{i=1}^{N_s} \text{FFN}_i^{(s)} (\mathbf{u}_t) + \sum_{i=1}^{N_r} g_{i,t} \text{FFN}_i^{(r)} (\mathbf{u}_t), \tag{20} g_{i,t} = \begin{cases} s_{i,t}, & \text{专家 } i \in \text{Topk}(\{s_{j,t} \mid 1 \leqslant j \leqslant N_r\}, K_r), \\ 0, & \text{其他}, \end{cases} \tag{21} s_{i,t} = \text{Softmax}_i (\mathbf{u}_t^\top \mathbf{e}_i), \tag{22}

其中 和 分别表示共享专家和路由专家的数量; 和 分别表示第 个共享专家和第 个路由专家; 表示激活的路由专家数量; 是第 个专家的门控值; 是 token 对专家的亲和度; 是该层中第 个路由专家的质心; 表示包含为第 个 token 和所有路由专家计算出的亲和度分数中最高的 个分数的集合。

2.2.2. 设备受限路由

我们设计了一种设备受限路由机制来限制 MoE 相关的通信成本。当采用专家并行时,路由专家将分布在多个设备上。对于每个 token,其 MoE 相关的通信频率与其目标专家所覆盖的设备数量成正比。由于 DeepSeekMoE 中细粒度的专家分割,激活的专家数量可能很大,因此如果我们应用专家并行,MoE 相关的通信将更加昂贵。

对于 DeepSeek-V2,除了朴素的路由专家 Top-K 选择外,我们还额外确保每个 token 的目标专家将分布在最多 个设备上。具体来说,对于每个 token,我们首先选择在其中具有最高亲和度分数的专家所在的 个设备。然后,我们在这些 个设备上的专家中执行 Top-K 选择。在实践中,我们发现当 时,设备受限路由可以实现与无限制 Top-K 路由大致相当的良好性能。

2.2.3. 负载均衡辅助损失

我们考虑了自动学习路由策略的负载均衡。首先,不平衡的负载会增加路由崩溃的风险(Shazeer et al., 2017),防止某些专家被充分训练和利用。其次,当采用专家并行时,不平衡的负载会降低计算效率。在 DeepSeek-V2 的训练过程中,我们设计了三种辅助损失,分别用于控制专家级负载均衡()、设备级负载均衡()和通信均衡()。

专家级平衡损失。我们使用专家级平衡损失(Fedus et al., 2021; Lepikhin et al., 2021)来减轻路由崩溃的风险:

\mathcal{L}_{\text{ExpBal}} = \alpha_1 \sum_{i=1}^{N_r} f_i P_i, \tag{23} f_i = \frac{N_r}{K_r T} \sum_{t=1}^T \mathbb{1}(\text{Token } t \text{ 选择专家 } i), \tag{24} P_i = \frac{1}{T} \sum_{t=1}^T s_{i,t}, \tag{25}

其中 是称为专家级平衡因子的超参数; 表示指示函数; 表示序列中的 token 数量。

设备级平衡损失。除了专家级平衡损失外,我们还额外设计了设备级平衡损失,以确保不同设备之间的计算平衡。在 DeepSeek-V2 的训练过程中,我们将所有路由专家划分为 个组 ,并将每组部署在单个设备上。设备级平衡损失计算如下:

\mathcal{L}_{\text{DevBal}} = \alpha_2 \sum_{i=1}^D f_i' P_i', \tag{26} f_i' = \frac{1}{|\mathcal{E}_i|} \sum_{j \in \mathcal{E}_i} f_j, \tag{27} P_i' = \sum_{j \in \mathcal{E}_i} P_j, \tag{28}

其中 是称为设备级平衡因子的超参数。

通信平衡损失。最后,我们引入了通信平衡损失,以确保每个设备的通信是平衡的。尽管设备受限路由机制保证了每个设备的发送通信是有界的,但如果某个设备

接收到的 token 比其他设备多,实际的通信效率也会受到影响。为了减轻这个问题,我们设计了如下通信平衡损失:

\mathcal{L}_{\text{CommBal}} = \alpha_3 \sum_{i=1}^D f_i'' P_i'', \tag{29} f_i'' = \frac{D}{MT} \sum_{t=1}^T \mathbb{1}(\text{Token } t \text{ 被发送到设备 } i), \tag{30} P_i'' = \sum_{j \in \mathcal{E}_i} P_j, \tag{31}

其中 是称为通信平衡因子的超参数。设备受限路由机制基于确保每个设备向其他设备传输最多 个隐藏状态的原则运行。同时,通信平衡损失被用于鼓励每个设备从其他设备接收大约 个隐藏状态。通信平衡损失保证了设备之间信息的平衡交换,促进了高效的通信。

2.2.4. Token 丢弃策略

虽然平衡损失旨在鼓励负载均衡,但必须承认它们不能保证严格的负载均衡。为了进一步减轻由不平衡负载引起的计算浪费,我们在训练期间引入了设备级 token 丢弃策略。该方法首先计算每个设备的平均计算预算,这意味着每个设备的容量因子等同于 1.0。然后,受 Riquelme 等人(2021)的启发,我们丢弃每个设备上亲和度分数最低的 token,直到达到计算预算。此外,我们确保属于大约 10% 训练序列的 token 永远不会被丢弃。通过这种方式,我们可以根据效率要求灵活决定在推理过程中是否丢弃 token,并始终确保训练和推理之间的一致性。

3. 预训练

3.1. 实验设置

3.1.1. 数据构建

在保持与 DeepSeek 67B(DeepSeek-AI, 2024)相同的数据处理阶段的同时,我们扩展了数据量并提升了数据质量。为了扩大我们的预训练语料库,我们探索了互联网数据的潜力并优化了我们的清洗流程,从而恢复了大量被错误删除的数据。此外,我们纳入了更多的中文数据,旨在更好地利用中国互联网上可用的语料库。除了数据量,我们还关注数据质量。我们用来自各种来源的高质量数据丰富了我们的预训练语料库,同时改进了基于质量的过滤算法。改进后的算法确保了大量无益数据将被删除,而有价值的数据将被大部分保留。此外,我们从预训练语料库中过滤掉了有争议的内容,以减轻特定区域文化带来的数据偏见。关于这种过滤策略影响的详细讨论在附录 E 中呈现。

我们采用了与 DeepSeek 67B 中使用的相同的分词器,它是基于字节级字节对编码(BBPE)算法构建的,词汇量为 100K。我们分词后的预训练语料库包含 8.1T token,其中中文 token 比英文 token 多约 12%。

3.1.2. 超参数

模型超参数。我们将 Transformer 层数设置为 60,隐藏维度设置为 5120。所有可学习参数均以 0.006 的标准差随机初始化。在 MLA 中,我们将注意力头数 设置为 128,每头维度 设置为 128。KV 压缩维度 设置为 512,查询压缩维度 设置为 1536。对于解耦查询和键,我们将每头维度 设置为 64。遵循 Dai 等人(2024)的方法,我们将除第一层外的所有 FFN 替换为 MoE 层。每个 MoE 层由 2 个共享专家和 160 个路由专家组成,其中每个专家的中间隐藏维度为 1536。在路由专家中,每个 token 将激活 6 个专家。此外,低秩压缩和细粒度专家分割将影响层的输出规模。因此,在实践中,我们在压缩潜在向量后采用了额外的 RMS Norm 层,并在宽度瓶颈(即压缩潜在向量和路由专家的中间隐藏状态)处乘以额外的缩放因子,以确保训练稳定。在这种配置下,DeepSeek-V2 总共包含 236B 个参数,其中每个 token 激活 21B 个参数。

训练超参数。我们采用 AdamW 优化器(Loshchilov and Hutter, 2017),超参数设置为 , weight_decay = 0.1。学习率使用预热和步进衰减策略(DeepSeek-AI, 2024)进行调度。最初,学习率在前 2K 步内从 0 线性增加到最大值。随后,学习率在训练约 60% 的 token 后乘以 0.316,在训练约 90% 的 token 后再次乘以 0.316。最大学习率设置为 ,梯度裁剪范数设置为 1.0。我们还使用了批处理大小调度策略,其中批处理大小在前 225B token 的训练中逐渐从 2304 增加到 9216,然后在剩余的训练中保持 9216。我们将最大序列长度设置为 4K,并在 8.1T token 上训练 DeepSeek-V2。我们利用流水线并行在不同设备上部署模型的不同层,对于每一层,路由专家将均匀部署在 8 个设备上()。至于设备受限路由,每个 token 最多将被发送到 3 个设备()。至于平衡损失,我们将 设置为 0.003, 设置为 0.05, 设置为 0.02。我们在训练期间采用 token 丢弃策略以进行加速,但在评估时不丢弃任何 token。

3.1.3. 基础设施

DeepSeek-V2 基于 HAI-LLM 框架(High-flyer, 2023)进行训练,这是我们工程师内部开发的高效轻量级训练框架。它采用了 16 路零气泡流水线并行(Qi et al., 2023)、8 路专家并行(Lepikhin et al., 2021)和 ZeRO-1 数据并行(Rajbhandari et al., 2020)。鉴于 DeepSeek-V2激活参数相对较少,且部分算子被重新计算以节省激活内存,因此它可以在无需张量并行的情况下进行训练,从而降低了通信开销。此外,为了进一步提高训练效率,我们将共享专家的计算与专家并行全对全(all-to-all)通信进行了重叠。我们还为通信、路由算法和不同专家之间的融合线性计算定制了更快的 CUDA 内核。此外,MLA 也基于 FlashAttention-2 的改进版本(Dao, 2023)进行了优化。

我们在配备 NVIDIA H800 GPU 的集群上进行了所有实验。H800 集群中的每个节点包含 8 个通过节点内 NVLink 和 NVSwitch 连接的 GPU。跨节点时,利用 InfiniBand 互连来促进通信。

3.1.4. 长上下文扩展

在 DeepSeek-V2 的初始预训练之后,我们采用 YaRN(Peng et al., 2023)将默认上下文窗口长度从 4K 扩展到 128K。YaRN 被专门应用于解耦共享键 ,因为它负责携带 RoPE(Su et al., 2024)。对于 YaRN,我们将缩放因子 设置为 40, 设置为 1, 设置为 32,目标最大上下文长度设置为 160K。在这些设置下,我们可以预期模型在 128K 的上下文长度下表现良好。与原始 YaRN 略有不同,由于我们独特的注意力机制,我们调整了长度缩放因子以调节注意力熵。因子 计算为 ,旨在最小化困惑度。

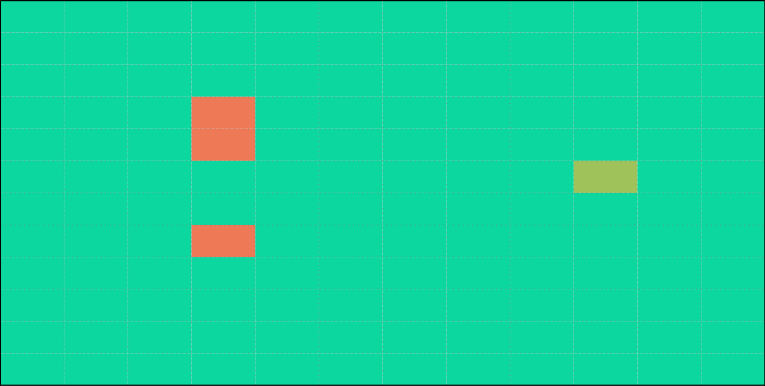

我们额外对模型进行了 1000 步的训练,序列长度为 32K,批处理大小为 576 个序列。尽管训练仅在 32K 的序列长度下进行,但该模型在 128K 的上下文长度下评估时仍表现出稳健的性能。如图 4 所示,“大海捞针”(NIAH)测试的结果表明,DeepSeek-V2 在高达 128K 的所有上下文窗口长度下都表现良好。

3.2. 评估

3.2.1. 评估基准

DeepSeek-V2 在双语语料库上进行了预训练,因此我们在英语和中文的一系列基准测试上对其进行了评估。我们的评估基于集成在 HAI-LLM 框架中的内部评估框架。包含的基准测试分类并列出如下,其中下划线标注的基准测试为中文:

- 多学科多项选择数据集包括 MMLU(Hendrycks et al., 2020)、C-Eval(Huang et al., 2023)和 CMMLU(Li et al., 2023)。

- 语言理解和推理数据集包括 HellaSwag(Zellers et al., 2019)、PIQA(Bisk et al., 2020)、ARC(Clark et al., 2018)和 BigBench Hard (BBH)(Suzgun et al., 2022)。

- 闭卷问答数据集包括 TriviaQA(Joshi et al., 2017)和 NaturalQuestions(Kwiatkowski et al., 2019)。

- 阅读理解数据集包括 RACE(Lai et al., 2017)、DROP(Dua et al., 2019)、C3(Sun et al., 2019)和 CMRC(Cui et al., 2019)。

- 指代消解数据集包括 WinoGrande(Sakaguchi et al., 2019)和 CLUEWSC(Xu et al., 2020)。

- 语言建模数据集包括 Pile(Gao et al., 2020)。

- 中文理解和文化数据集包括 CHID(Zheng et al., 2019)和 CCPM(Li et al., 2021)。

- 数学数据集包括 GSM8K(Cobbe et al., 2021)、MATH(Hendrycks et al., 2021)和 CMath(Wei et al., 2023)。

- 代码数据集包括 HumanEval(Chen et al., 2021)、MBPP(Austin et al., 2021)和 CRUXEval(Gu et al., 2024)。

- 标准化考试包括 AGIEval(Zhong et al., 2023)。注意 AGIEval 包含英语和中文子集。

遵循我们之前的工作(DeepSeek-AI, 2024),我们对包括 HellaSwag、PIQA、WinoGrande、RACE-Middle、RACE-High、MMLU、ARC-Easy、ARC-Challenge、CHID、C-Eval、CMMLU、C3 和 CCPM 在内的数据集采用基于困惑度的评估,并对 TriviaQA、NaturalQuestions、DROP、MATH、GSM8K、HumanEval、MBPP、CRUXEval、BBH、AGIEval、CLUEWSC、CMRC 和 CMath 采用基于生成的评估。此外,我们对 Pile-test 执行基于语言建模的评估,并使用每字节比特数(BPB)作为指标,以确保不同分词器的模型之间进行公平比较。

为了直观地概述这些基准测试,我们在附录 G 中额外提供了每个基准测试的评估格式。

3.2.2. 评估结果

在表 2 中,我们将 DeepSeek-V2 与几个代表性的开源模型进行了比较,包括 DeepSeek 67B(DeepSeek-AI, 2024)(我们之前的版本)、Qwen1.5 72B(Bai et al., 2023)、LLaMA3 70B(AI@Meta, 2024)和 Mixtral 8x22B(Mistral, 2024)。我们使用我们的内部评估框架评估所有这些模型,并确保它们共享相同的评估设置。总体而言,在仅激活 21B 参数的情况下,DeepSeek-V2 在几乎所有基准测试中都显著优于 DeepSeek 67B,并在开源模型中实现了顶级性能。

此外,我们仔细地将 DeepSeek-V2 与其开源对应模型逐一进行了比较。(1) 与同样支持中文和英语的 Qwen1.5 72B 相比,DeepSeek-V2 在大多数英语、代码和数学基准测试中表现出压倒性优势。至于中文基准测试,Qwen1.5 72B 在多学科多项选择任务中表现更好,而 DeepSeek-V2 在其他任务上表现相当或更好。注意,对于 CHID 基准测试,Qwen1.5 72B 的分词器在我们的评估框架中会遇到错误,因此我们将 Qwen1.5 72B 的 CHID 分数留空。(2) 与 Mixtral 8x22B 相比,DeepSeek-V2 实现了相当或更好的英语性能,除了与英语常识知识密切相关的 TriviaQA、NaturalQuestions 和 HellaSwag。值得注意的是,DeepSeek-V2 在 MMLU 上优于 Mixtral 8x22B。在代码和数学基准测试中,DeepSeek-V2 表现出与 Mixtral 8x22B 相当的性能。由于 Mixtral 8x22B 没有专门针对中文数据进行训练,其中文能力远远落后于 DeepSeek-V2。(3) 与 LLaMA3 70B 相比,DeepSeek-V2 训练的英语 token 不到其四分之一。因此,我们承认 DeepSeek-V2 在基础英语能力上与 LLaMA3 70B 仍有微小差距。然而,即使训练 token 和激活参数少得多,DeepSeek-V2 仍然表现出与 LLaMA3 70B 相当的代码和数学能力。此外,作为一种双语语言模型,DeepSeek-V2 在中文基准测试上以压倒性优势优于 LLaMA3 70B。

最后,值得一提的是,某些先前的研究(Hu et al., 2024)在预训练阶段纳入了 SFT 数据,而 DeepSeek-V2 在预训练期间从未接触过 SFT 数据。

| 基准测试(指标) | Shots | DeepSeek 67B | Qwen1.5 72B | Mixtral 8x22B | LLaMA 3 70B | DeepSeek-V2 |

|---|---|---|---|---|---|---|

| 架构 | - | Dense | Dense | MoE | Dense | MoE |

| # 激活参数 | - | 67B | 72B | 39B | 70B | 21B |

| # 总参数 | - | 67B | 72B | 141B | 70B | 236B |

| 英语 | ||||||

| Pile-test (BPB) | - | 0.642 | 0.637 | 0.623 | 0.602 | 0.606 |

| BBH (EM) | 3-shot | 68.7 | 59.9 | 78.9 | 81.0 | 78.9 |

| MMLU (Acc.) | 5-shot | 71.3 | 77.2 | 77.6 | 78.9 | 78.5 |

| DROP (F1) | 3-shot | 69.7 | 71.5 | 80.4 | 82.5 | 80.1 |

| ARC-Easy (Acc.) | 25-shot | 95.3 | 97.1 | 97.3 | 97.9 | 97.6 |

| ARC-Challenge (Acc.) | 25-shot | 86.4 | 92.8 | 91.2 | 93.3 | 92.4 |

| HellaSwag (Acc.) | 10-shot | 86.3 | 85.8 | 86.6 | 87.9 | 84.2 |

| PIQA (Acc.) | 0-shot | 83.6 | 83.3 | 83.6 | 85.0 | 83.7 |

| WinoGrande (Acc.) | 5-shot | 84.9 | 82.4 | 83.7 | 85.7 | 84.9 |

| RACE-Middle (Acc.) | 5-shot | 69.9 | 63.4 | 73.3 | 73.3 | 73.1 |

| RACE-High (Acc.) | 5-shot | 50.7 | 47.0 | 56.7 | 57.9 | 52.7 |

| TriviaQA (EM) | 5-shot | 78.9 | 73.1 | 82.1 | 81.6 | 79.9 |

| NaturalQuestions (EM) | 5-shot | 36.6 | 35.6 | 39.6 | 40.2 | 38.7 |

| AGIEval (Acc.) | 0-shot | 41.3 | 64.4 | 43.4 | 49.8 | 51.2 |

| 代码 | ||||||

| HumanEval (Pass@1) | 0-shot | 45.1 | 43.9 | 53.1 | 48.2 | 48.8 |

| MBPP (Pass@1) | 3-shot | 57.4 | 53.6 | 64.2 | 68.6 | 66.6 |

| CRUXEval-I (Acc.) | 2-shot | 42.5 | 44.3 | 52.4 | 49.4 | 52.8 |

| CRUXEval-O (Acc.) | 2-shot | 41.0 | 42.3 | 52.8 | 54.3 | 49.8 |

| 数学 | ||||||

| GSM8K (EM) | 8-shot | 63.4 | 77.9 | 80.3 | 83.0 | 79.2 |

| MATH (EM) | 4-shot | 18.7 | 41.4 | 42.5 | 42.2 | 43.6 |

| CMath (EM) | 3-shot | 63.0 | 77.8 | 72.3 | 73.9 | 78.7 |

| 中文 | ||||||

| CLUEWSC (EM) | 5-shot | 81.0 | 80.5 | 77.5 | 78.3 | 82.2 |

| C-Eval (Acc.) | 5-shot | 66.1 | 83.7 | 59.6 | 67.5 | 81.7 |

| CMMLU (Acc.) | 5-shot | 70.8 | 84.3 | 60.0 | 69.3 | 84.0 |

| CMRC (EM) | 1-shot | 73.4 | 66.6 | 73.1 | 73.3 | 77.5 |

| C3 (Acc.) | 0-shot | 75.3 | 78.2 | 71.4 | 74.0 | 77.4 |

| CHID (Acc.) | 0-shot | 92.1 | - | 57.0 | 83.2 | 92.7 |

| CCPM (Acc.) | 0-shot | 88.5 | 88.1 | 61.0 | 68.1 | 93.1 |

表 2 | DeepSeek-V2 与其他代表性开源模型的比较。所有模型均在我们的内部框架中进行评估,并共享相同的评估设置。粗体表示最佳,下划线表示第二佳。差距小于 0.3 的分数被视为处于同一水平。在仅激活 21B 参数的情况下,DeepSeek-V2 在开源模型中实现了顶级性能。

3.2.3. 训练和推理效率

训练成本。由于 DeepSeek-V2 为每个 token 激活的参数更少,且所需的 FLOPs 比 DeepSeek 67B 更少,因此从理论上讲,训练 DeepSeek-V2 将比训练 DeepSeek 67B 更经济。尽管训练 MoE 模型会引入额外的通信开销,但通过我们的算子和通信优化,DeepSeek-V2 的训练可以达到相对较高的模型 FLOPs 利用率(MFU)。在我们 H800 集群上的实际训练中,对于每万亿 token 的训练,DeepSeek 67B 需要 300.6K GPU 小时,而 DeepSeek-V2 仅需 172.8K GPU 小时,即稀疏 DeepSeek-V2 与稠密 DeepSeek 67B 相比可节省 42.5% 的训练成本。

推理效率。为了高效地部署 DeepSeek-V2 进行服务,我们首先将其参数转换为 FP8 精度。此外,我们还对 DeepSeek-V2 执行了 KV 缓存量化(Hooper et al., 2024; Zhao et al., 2023),以进一步将其 KV 缓存中的每个元素平均压缩为 6 位。得益于 MLA 和这些优化,实际部署的 DeepSeek-V2 所需的 KV 缓存显著少于 DeepSeek 67B,因此可以服务更大的批处理大小。我们基于实际部署的 DeepSeek 67B 服务中的提示和生成长度分布,评估了 DeepSeek-V2 的生成吞吐量。在配备 8 个 H800 GPU 的单节点上,DeepSeek-V2 的生成吞吐量超过每秒 50K token,是 DeepSeek 67B 最大生成吞吐量的 5.76 倍。此外,DeepSeek-V2 的提示输入吞吐量超过每秒 100K token。

4. 对齐

4.1. 监督微调

基于我们之前的研究(DeepSeek-AI, 2024),我们整理了我们的指令微调数据集,包含 1.5M 个实例,其中 1.2M 个实例用于有用性,0.3M 个实例用于安全性。与初始版本相比,我们提高了数据质量,以减轻幻觉响应并增强写作能力。我们用 2 个 epoch 对 DeepSeek-V2 进行了微调,学习率设置为 。对于 DeepSeek-V2 Chat (SFT) 的评估,我们主要包括基于生成的基准测试,除了几个代表性的多项选择任务(MMLU 和 ARC)。我们还对 DeepSeek-V2 Chat (SFT) 进行了指令遵循评估(IFEval)(Zhou et al., 2023),使用提示级宽松准确率作为指标。此外,我们使用 2023 年 9 月 1 日至 2024 年 4 月 1 日的 LiveCodeBench(Jain et al., 2024)问题来评估聊天模型。除了标准基准测试外,我们还在开放式对话基准测试上进一步评估了我们的模型,包括 MT-Bench(Zheng et al., 2023)、AlpacaEval 2.0(Dubois et al., 2024)和 AlignBench(Liu et al., 2023)。为了进行比较,我们还在我们的评估框架和设置中评估了 Qwen1.5 72B Chat、LLaMA-3-70B Instruct 和 Mistral-8x22B Instruct。至于 DeepSeek 67B Chat,我们直接参考了我们之前版本中报告的评估结果。

4.2. 强化学习

为了进一步释放 DeepSeek-V2 的潜力并使其与人类偏好对齐,我们进行了强化学习(RL)以调整其偏好。

强化学习算法。为了节省 RL 的训练成本,我们采用了组相对策略优化(GRPO)(Shao et al., 2024),它放弃了通常与策略模型大小相同的评论家模型,而是从组分数中估计基线。具体来说,对于每个问题 ,GRPO 从旧策略 中采样一组输出 ,然后通过最大化以下目标来优化策略模型 :

\mathcal{J}_{GRPO}(\theta) = \mathbb{E}[q \sim P(Q), \{o_i\}_{i=1}^G \sim \pi_{\theta_{old}}(o|q)] \frac{1}{G} \sum_{i=1}^G \left( \min \left( \frac{\pi_\theta(o_i|q)}{\pi_{\theta_{old}}(o_i|q)} A_i, \text{clip} \left( \frac{\pi_\theta(o_i|q)}{\pi_{\theta_{old}}(o_i|q)}, 1-\varepsilon, 1+\varepsilon \right) A_i \right) - \beta D_{KL}(\pi_\theta || \pi_{ref}) \right), \tag{32} D_{KL}(\pi_\theta || \pi_{ref}) = \frac{\pi_{ref}(o_i|q)}{\pi_\theta(o_i|q)} - \log \frac{\pi_{ref}(o_i|q)}{\pi_\theta(o_i|q)} - 1, \tag{33}

其中 和 是超参数; 是优势,使用每组中对应于输出的一组奖励 计算得出:

A_i = \frac{r_i - \text{mean}(\{r_1, r_2, \dots, r_G\})}{\text{std}(\{r_1, r_2, \dots, r_G\})}. \tag{34}

训练策略。在我们的初步实验中,我们发现对推理数据(如代码和数学提示)进行的 RL 训练表现出与通用数据训练不同的独特特征。例如,我们模型的数学和编码能力可以在更长的训练步骤中持续提高。因此,我们采用了两阶段 RL 训练策略,首先进行推理对齐,然后进行人类偏好对齐。在第一阶段推理对齐中,我们为代码和数学推理任务训练了一个奖励模型 ,并利用 的反馈优化策略模型:

r_i = RM_{reasoning}(o_i). \tag{35}

在第二阶段人类偏好对齐中,我们采用了多奖励框架,该框架从有用性奖励模型 、安全性奖励模型 和基于规则的奖励模型 获取奖励。响应 的最终奖励为:

r_i = c_1 \cdot RM_{helpful}(o_i) + c_2 \cdot RM_{safety}(o_i) + c_3 \cdot RM_{rule}(o_i), \tag{36}

其中 和 是相应的系数。

为了获得在 RL 训练中起关键作用的可靠奖励模型,我们仔细收集了偏好数据,并一丝不苟地进行了质量过滤和比例调整。我们基于编译器反馈获得了代码偏好数据,并基于真值标签获得了数学偏好数据。对于奖励模型训练,我们使用 DeepSeek-V2 Chat (SFT) 初始化奖励模型,并使用点对点或成对损失对它们进行训练。在我们的实验中,我们观察到 RL 训练可以充分挖掘并激活我们模型的潜力,使其能够从可能的响应中选择正确且令人满意的答案。

训练效率优化。在超大规模模型上进行 RL 训练对训练框架提出了很高的要求。它需要仔细的工程优化来管理 GPU 内存和 RAM 压力,同时保持快速的训练速度。为此,我们实施了以下工程优化。(1) 首先,我们提出了一个混合引擎,分别为训练和推理采用不同的并行策略,以实现更高的 GPU 利用率。(2) 其次,我们利用 vLLM(Kwon et al., 2023)并结合大批处理大小作为我们的推理后端,以加速推理速度。(3) 第三,我们仔细设计了一种将模型卸载到 CPU 并将模型加载回 GPU 的调度策略,这在训练速度和内存消耗之间实现了近乎最优的平衡。

4.3. 评估结果

标准基准测试评估。最初,我们在标准基准测试上评估了 DeepSeek-V2 Chat (SFT) 和 DeepSeek-V2 Chat (RL)。值得注意的是,与基础版本相比,DeepSeek-V2 Chat (SFT) 在 GSM8K、MATH 和 HumanEval 评估中表现出显著的改进。这一进展可归因于我们 SFT 数据的纳入,其中包含大量数学和代码相关内容。此外,DeepSeek-V2 Chat (RL) 进一步提升了在数学和代码基准测试上的性能。我们在附录 F 中展示了更多的代码和数学评估。

至于与其他模型的比较,我们首先将 DeepSeek-V2 Chat (SFT) 与 Qwen1.5 72B Chat 进行了比较,发现 DeepSeek-V2 Chat (SFT) 在几乎所有英语、数学和代码基准测试中都超过了 Qwen1.5 72B Chat。在中文基准测试上,DeepSeek-V2 Chat (SFT) 在多学科多项选择任务上的得分略低于 Qwen1.5 72B Chat,这与其基础版本的表现一致。当与最先进的开源 MoE 模型 Mixtral 8x22B Instruct 相比时,DeepSeek-V2 Chat (SFT) 在大多数基准测试中表现出更好的性能,除了 NaturalQuestions 和 IFEval。此外,与最先进的开源模型 LLaMA3 70B Chat 相比,DeepSeek-V2 Chat (SFT) 在代码和数学相关基准测试中表现出相似的性能。LLaMA3 70B Chat 在 MMLU 和 IFEval 上表现更好,而 DeepSeek-V2 Chat (SFT) 在中文任务上表现出更强的性能。最终,与 DeepSeek-V2 Chat (SFT) 相比,DeepSeek-V2 Chat (RL) 在数学和编码任务中表现出进一步增强的性能。这些比较突显了 DeepSeek-V2 Chat 在各个领域和语言中相对于其他语言模型的优势。

开放式生成评估。我们继续在开放式对话基准测试上对我们的模型进行了额外评估。对于英语开放式对话生成,我们利用 MT-Bench 和 AlpacaEval 2.0 作为基准测试。表 4 中呈现的评估结果证明了 DeepSeek-V2 Chat (RL) 相对于 DeepSeek-V2 Chat (SFT) 的显著性能优势。这一结果展示了我们的 RL 训练在实现改进对齐方面的有效性。与其他开源模型相比,DeepSeek-V2 Chat (RL) 在这两个基准测试上都表现出优于 Mistral 8x22B Instruct 和 Qwen1.5 72B Chat 的性能。与 LLaMA3 70B Instruct 相比,DeepSeek-V2 Chat (RL) 在 MT-Bench 上表现出竞争性的性能,并在 AlpacaEval 2.0 上显著优于它。这些结果突显了 DeepSeek-V2 Chat (RL) 在生成高质量和上下文相关响应方面的强大性能,特别是在基于指令的对话任务中。

此外,我们基于 AlignBench 评估了中文开放式生成能力。如表 5 所示,DeepSeek-V2 Chat (RL) 相对于 DeepSeek-V2 Chat (SFT) 表现出微弱优势。值得注意的是,DeepSeek-V2 Chat (SFT) 以显著的优势超过了所有开源中文模型。它显著优于第二好的开源模型 Qwen1.5 72B Chat 在中文推理和语言方面的表现。此外,DeepSeek-V2 Chat (SFT) 和 DeepSeek-V2 Chat (RL) 都优于 GPT-4-0613 和 ERNIEBot 4.0,巩固了我们的模型在支持中文的顶级 LLM 中的地位。具体而言,DeepSeek-V2 Chat (RL) 在中文语言理解方面表现出卓越的性能,优于包括 GPT-4-Turbo-1106-Preview 在内的所有模型。另一方面,DeepSeek-V2 Chat (RL) 的推理能力仍落后于巨型模型,如 Erniebot-4.0 和 GPT-4s。

| 基准测试 | Shots | DeepSeek 67B Chat | Qwen 1.5 72B Chat | LLaMA3 70B Inst. | Mixtral 8x22B Inst. | DeepSeek-V2 Chat (SFT) | DeepSeek-V2 Chat (RL) |

|---|---|---|---|---|---|---|---|

| 上下文长度 | - | 4K | 32K | 8K | 64K | 128K | 128K |

| 架构 | - | Dense | Dense | Dense | MoE | MoE | MoE |

| # 激活参数 | - | 67B | 72B | 70B | 39B | 21B | 21B |

| # 总参数 | - | 67B | 72B | 70B | 141B | 236B | 236B |

| 英语 | |||||||

| TriviaQA | 5-shot | 81.5 | 79.6 | 69.1 | 80.0 | 85.4 | 86.7 |

| NaturalQuestions | 5-shot | 47.0 | 46.9 | 44.6 | 54.9 | 51.9 | 53.4 |

| MMLU | 5-shot | 71.1 | 76.2 | 80.3 | 77.8 | 78.4 | 77.8 |

| ARC-Easy | 25-shot | 96.6 | 96.8 | 96.9 | 97.1 | 97.6 | 98.1 |

| ARC-Challenge | 25-shot | 88.9 | 91.7 | 92.6 | 90.0 | 92.5 | 92.3 |

| BBH | 3-shot | 71.7 | 65.9 | 80.1 | 78.4 | 81.3 | 79.7 |

| AGIEval | 0-shot | 46.4 | 62.8 | 56.6 | 41.4 | 63.2 | 61.4 |

| IFEval | 0-shot | 55.5 | 57.3 | 79.7 | 72.1 | 64.1 | 63.8 |

| 代码 | |||||||

| HumanEval | 0-shot | 73.8 | 68.9 | 76.2 | 75.0 | 76.8 | 81.1 |

| MBPP | 3-shot | 61.4 | 52.2 | 69.8 | 64.4 | 70.4 | 72.0 |

| CRUXEval-I-COT | 2-shot | 49.1 | 51.4 | 61.1 | 59.4 | 59.5 | 61.5 |

| CRUXEval-O-COT | 2-shot | 50.9 | 56.5 | 63.6 | 63.6 | 60.7 | 63.0 |

| LiveCodeBench | 0-shot | 18.3 | 18.8 | 30.5 | 25.0 | 28.7 | 32.5 |

| 数学 | |||||||

| GSM8K | 8-shot | 84.1 | 81.9 | 93.2 | 87.9 | 90.8 | 92.2 |

| MATH | 4-shot | 32.6 | 40.6 | 48.5 | 49.8 | 52.7 | 53.9 |

| CMath | 0-shot | 80.3 | 82.8 | 79.2 | 75.1 | 82.0 | 81.9 |

| 中文 | |||||||

| CLUEWSC | 5-shot | 78.5 | 90.1 | 85.4 | 75.8 | 88.6 | 89.9 |

| C-Eval | 5-shot | 65.2 | 82.2 | 67.9 | 60.0 | 80.9 | 78.0 |

| CMMLU | 5-shot | 67.8 | 82.9 | 70.7 | 61.0 | 82.4 | 81.6 |

表 3 | DeepSeek-V2 Chat (SFT)、DeepSeek-V2 Chat (RL) 与其他代表性开源聊天模型的比较。关于 TriviaQA 和 NaturalQuestions,值得注意的是,聊天模型(如 LLaMA3 70B Instruct)可能不会严格遵守少样本设置中通常指定的格式约束。因此,这可能导致在我们的评估框架中对某些模型产生低估。

| 模型 | MT-Bench | AlpacaEval 2.0 |

|---|---|---|

| DeepSeek 67B Chat | 8.35 | 16.6 |

| Mistral 8x22B Instruct v0.1 | 8.66 | 30.9 |

| Qwen1.5 72B Chat | 8.61 | 36.6 |

| LLaMA3 70B Instruct | 8.95 | 34.4 |

| DeepSeek-V2 Chat (SFT) | 8.62 | 30.0 |

| DeepSeek-V2 Chat (RL) | 8.97 | 38.9 |

表 4 | 英语开放式对话评估。对于 AlpacaEval 2.0,我们使用长度控制胜率作为指标。

4.4. 讨论

SFT 数据量。围绕大规模 SFT 语料库必要性的讨论一直是激烈争论的话题。先前的研究(Young et al., 2024; Zhou et al., 2024)认为,少于 10K 个 SFT 数据实例就足以产生令人满意的结果。然而,在我们的实验中,我们观察到如果我们使用少于 10K 个实例,IFEval 基准测试的性能会显著下降。一种可能的解释是,语言模型需要一定量的数据来发展特定的技能。虽然随着模型规模的增加,所需的数据量可能会减少,但它不能完全消除。我们的观察强调了充足的数据对于赋予 LLM 所需能力的关键需求。此外,SFT 数据的质量也至关重要,特别是对于涉及写作或开放式问题的任务。

强化学习的对齐税。在人类偏好对齐期间,我们观察到在开放式生成基准测试上,就 AI 和人类评估者评分而言,性能有显著提升。然而,我们也注意到“对齐税”(Ouyang et al., 2022)现象,即对齐过程可能会对 BBH 等某些标准基准测试的性能产生负面影响。为了减轻对齐税,在 RL 阶段,我们在数据处理和改进训练策略方面做出了重大努力,最终在标准基准测试和开放式基准测试的性能之间取得了可容忍的权衡。探索如何在不损害其通用性能的情况下将模型与人类偏好对齐,为未来的研究提供了一个有价值的方向。

在线强化学习。在我们的偏好对齐实验中,我们发现在线方法显著优于离线方法。因此,我们投入了巨大的努力来实现用于对齐 DeepSeek-V2 的在线 RL 框架。关于在线或离线偏好对齐的结论在不同背景下可能会有所不同,我们保留对它们进行更彻底的比较和分析以供未来研究。

5. 结论、局限性与未来工作

在本文中,我们介绍了 DeepSeek-V2,这是一种支持 128K 上下文长度的大型 MoE 语言模型。除了强大的性能外,它还具有经济的训练和高效的推理特点,得益于其包括 MLA 和 DeepSeekMoE 在内的创新架构。在实践中,与 DeepSeek 67B 相比,DeepSeek-V2 实现了显著更强的性能,同时节省了 42.5% 的训练成本,将 KV 缓存减少了 93.3%,并将最大生成吞吐量提升至 5.76 倍。评估结果进一步表明,即使仅激活 21B 个参数,DeepSeek-V2 也在开源模型中实现了顶级性能,并成为最强的开源 MoE 语言模型。

DeepSeek-V2 及其聊天版本共享其他 LLM 中常见的已知局限性,包括预训练后缺乏持续的知识更新、生成非事实信息(如未经证实的建议)的可能性,以及产生幻觉的机会。此外,由于我们的数据主要由中文和英文内容组成,我们的模型在其他语言中可能表现出有限的熟练度。在中文和英文之外的场景中,应谨慎使用。

DeepSeek 将继续以长期主义投资开源大模型,旨在逐步接近通用人工智能的目标。

- 在我们正在进行的探索中,我们致力于设计能够进一步扩展 MoE 模型规模,同时保持经济的训练和推理成本的方法。我们下一步的目标是在即将发布的版本中实现与 GPT-4 相当的性能。

- 我们的对齐团队不断努力增强我们的模型,旨在开发一个不仅对全球用户有用,而且诚实、安全的模型。我们的最终目标是将我们模型的价值观与人类价值观对齐,同时最大限度地减少对人类监督的需求。通过优先考虑伦理考量和负责任的开发,我们致力于对社会产生积极和有益的影响。

- 目前,DeepSeek-V2 仅支持文本模态。在我们的前瞻性议程中,我们打算使我们的模型支持多种模态,从而在更广泛的场景中增强其多功能性和实用性。

参考文献

AI@Meta. Llama 3 model card, 2024. URL https://github.com/meta-llama/llama3/blob/main/MODEL_CARD.md.

J. Ainslie, J. Lee-Thorp, M. de Jong, Y. Zemlyanskiy, F. Lebrón, and S. Sanghai. Gqa: Training generalized multi-query transformer models from multi-head checkpoints. arXiv preprint arXiv:2305.13245, 2023.

Anthropic. Introducing Claude, 2023. URL https://www.anthropic.com/index/introducing-claude.

J. Austin, A. Odena, M. Nye, M. Bosma, H. Michalewski, D. Dohan, E. Jiang, C. Cai, M. Terry, Q. Le, et al. Program synthesis with large language models. arXiv preprint arXiv:2108.07732, 2021.

J. Bai, S. Bai, Y. Chu, Z. Cui, K. Dang, X. Deng, Y. Fan, W. Ge, Y. Han, F. Huang, B. Hui, L. Ji, M. Li, J. Lin, R. Lin, D. Liu, G. Liu, C. Lu, K. Lu, J. Ma, R. Men, X. Ren, X. Ren, C. Tan, S. Tan, J. Tu, P. Wang, S. Wang, W. Wang, S. Wu, B. Xu, J. Xu, A. Yang, H. Yang, J. Yang, S. Yang, Y. Yao, B. Yu, H. Yuan, Z. Yuan, J. Zhang, X. Zhang, Y. Zhang, Z. Zhang, C. Zhou, J. Zhou, X. Zhou, and T. Zhu. Qwen technical report. arXiv preprint arXiv:2309.16609, 2023.

Y. Bisk, R. Zellers, R. L. Bras, J. Gao, and Y. Choi. PIQA: reasoning about physical commonsense in natural language. In The Thirty-Fourth AAAI Conference on Artificial Intelligence, AAAI 2020, The Thirty-Second Innovative Applications of Artificial Intelligence Conference, IAAI 2020, The Tenth AAAI Symposium on Educational Advances in Artificial Intelligence, EAAI 2020, New York, NY, USA, February 7-12, 2020, pages 7432–7439. AAAI Press, 2020. doi: 10.1609/aaai.v34i05.6239. URL https://doi.org/10.1609/aaai.v34i05.6239.

M. Chen, J. Tworek, H. Jun, Q. Yuan, H. P. de Oliveira Pinto, J. Kaplan, H. Edwards, Y. Burda, N. Joseph, G. Brockman, A. Ray, R. Puri, G. Krueger, M. Petrov, H. Khlaaf, G. Sastry, P. Mishkin, B. Chan, S. Gray, N. Ryder, M. Pavlov, A. Power, L. Kaiser, M. Bavarian, C. Winter, P. Tillet, F. P. Such, D. Cummings, M. Plappert, F. Chantzis, E. Barnes, A. Herbert-Voss, W. H. Guss, A. Nichol, A. Paino, N. Tezak, J. Tang, I. Babuschkin, S. Balaji, S. Jain, W. Saunders, C. Hesse, A. N. Carr, J. Leike, J. Achiam, V. Misra, E. Morikawa, A. Radford, M. Knight, M. Brundage, M. Murati, K. Mayer, P. Welinder, B. McGrew, D. Amodei, S. McCandlish, I. Sutskever, and W. Zaremba. Evaluating large language models trained on code. CoRR, abs/2107.03374, 2021. URL https://arxiv.org/abs/2107.03374.

P. Clark, I. Cowhey, O. Etzioni, T. Khot, A. Sabharwal, C. Schoenick, and O. Tafjord. Think you have solved question answering? try arc, the AI2 reasoning challenge. CoRR, abs/1803.05457, 2018. URL http://arxiv.org/abs/1803.05457.

K. Cobbe, V. Kosaraju, M. Bavarian, M. Chen, H. Jun, L. Kaiser, M. Plappert, J. Tworek, J. Hilton, R. Nakano, et al. Training verifiers to solve math word problems. arXiv preprint arXiv:2110.14168, 2021.

Y. Cui, T. Liu, W. Che, L. Xiao, Z. Chen, W. Ma, S. Wang, and G. Hu. A span-extraction dataset for Chinese machine reading comprehension. In K. Inui, J. Jiang, V. Ng, and X. Wan, editors, Proceedings of the 2019 Conference on Empirical Methods in Natural Language Processing and the 9th International Joint Conference on Natural Language Processing (EMNLP-IJCNLP), pages 5883–5889, Hong Kong, China, Nov. 2019. Association for Computational Linguistics. doi: 10.18653/v1/D19-1600. URL https://aclanthology.org/D19-1600.

D. Dai, C. Deng, C. Zhao, R. X. Xu, H. Gao, D. Chen, J. Li, W. Zeng, X. Yu, Y. Wu, Z. Xie, Y. K. Li, P. Huang, F. Luo, C. Ruan, Z. Sui, and W. Liang. Deepseekmoe: Towards ultimate expert specialization in mixture-of-experts language models. CoRR, abs/2401.06066, 2024. URL https://doi.org/10.48550/arXiv.2401.06066.

T. Dao. FlashAttention-2: Faster attention with better parallelism and work partitioning, 2023.

DeepSeek-AI. Deepseek LLM: scaling open-source language models with longtermism. CoRR, abs/2401.02954, 2024. URL https://doi.org/10.48550/arXiv.2401.02954.

D. Dua, Y. Wang, P. Dasigi, G. Stanovsky, S. Singh, and M. Gardner. DROP: A reading comprehension benchmark requiring discrete reasoning over paragraphs. In J. Burstein, C. Doran, and T. Solorio, editors, Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies, NAACL-HLT 2019, Minneapolis, MN, USA, June 2-7, 2019, Volume 1 (Long and Short Papers), pages 2368–2378. Association for Computational Linguistics, 2019. doi: 10.18653/V1/N19-1246. URL https://doi.org/10.18653/v1/n19-1246.

Y. Dubois, B. Galambosi, P. Liang, and T. B. Hashimoto. Length-controlled alpacaeval: A simple way to debias automatic evaluators. arXiv preprint arXiv:2404.04475, 2024.

W. Fedus, B. Zoph, and N. Shazeer. Switch transformers: Scaling to trillion parameter models with simple and efficient sparsity. CoRR, abs/2101.03961, 2021. URL https://arxiv.org/abs/2101.03961.

L. Gao, S. Biderman, S. Black, L. Golding, T. Hoppe, C. Foster, J. Phang, H. He, A. Thite, N. Nabeshima, et al. The Pile: An 800GB dataset of diverse text for language modeling. arXiv preprint arXiv:2101.00027, 2020.

Google. Introducing gemini: our largest and most capable ai model, 2023. URL https://blog.google/technology/ai/google-gemini-ai/.

A. Gu, B. Rozière, H. Leather, A. Solar-Lezama, G. Synnaeve, and S. I. Wang. Cruxeval: A benchmark for code reasoning, understanding and execution, 2024.

D. Hendrycks, C. Burns, S. Basart, A. Zou, M. Mazeika, D. Song, and J. Steinhardt. Measuring massive multitask language understanding. arXiv preprint arXiv:2009.03300, 2020.

D. Hendrycks, C. Burns, S. Kadavath, A. Arora, S. Basart, E. Tang, D. Song, and J. Steinhardt. Measuring mathematical problem solving with the math dataset. arXiv preprint arXiv:2103.03874, 2021.

High-flyer. Hai-llm: 高效且轻量的大模型训练工具, 2023. URL https://www.high-flyer.cn/en/blog/hai-llm.

C. Hooper, S. Kim, H. Mohammadzadeh, M. W. Mahoney, Y. S. Shao, K. Keutzer, and A. Gholami. Kvquant: Towards 10 million context length LLM inference with KV cache quantization. CoRR, abs/2401.18079, 2024. URL https://doi.org/10.48550/arXiv.2401.18079.

S. Hu, Y. Tu, X. Han, C. He, G. Cui, X. Long, Z. Zheng, Y. Fang, Y. Huang, W. Zhao, et al. Minicpm: Unveiling the potential of small language models with scalable training strategies. arXiv preprint arXiv:2404.06395, 2024.

Y. Huang, Y. Bai, Z. Zhu, J. Zhang, J. Zhang, T. Su, J. Liu, C. Lv, Y. Zhang, J. Lei, et al. C-Eval: A multi-level multi-discipline chinese evaluation suite for foundation models. arXiv preprint arXiv:2305.08322, 2023.

N. Jain, K. Han, A. Gu, W.-D. Li, F. Yan, T. Zhang, S. Wang, A. Solar-Lezama, K. Sen, and I. Stoica. Livecodebench: Holistic and contamination free evaluation of large language models for code. arXiv preprint arXiv:2403.07974, 2024.

M. Joshi, E. Choi, D. Weld, and L. Zettlemoyer. TriviaQA: A large scale distantly supervised challenge dataset for reading comprehension. In R. Barzilay and M.-Y. Kan, editors, Proceedings of the 55th Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers), pages 1601–1611, Vancouver, Canada, July 2017. Association for Computational Linguistics. doi: 10.18653/v1/P17-1147. URL https://aclanthology.org/P17-1147.

T. Kwiatkowski, J. Palomaki, O. Redfield, M. Collins, A. P. Parikh, C. Alberti, D. Epstein, I. Polosukhin, J. Devlin, K. Lee, K. Toutanova, L. Jones, M. Kelcey, M. Chang, A. M. Dai, J. Uszkoreit, Q. Le, and S. Petrov. Natural questions: a benchmark for question answering research. Trans. Assoc. Comput. Linguistics, 7:452–466, 2019. doi: 10.1162/tacl_a_00276. URL https://doi.org/10.1162/tacl_a_00276.

W. Kwon, Z. Li, S. Zhuang, Y. Sheng, L. Zheng, C. H. Yu, J. E. Gonzalez, H. Zhang, and I. Stoica. Efficient memory management for large language model serving with pagedattention. In Proceedings of the ACM SIGOPS 29th Symposium on Operating Systems Principles, 2023.

G. Lai, Q. Xie, H. Liu, Y. Yang, and E. H. Hovy. RACE: large-scale reading comprehension dataset from examinations. In M. Palmer, R. Hwa, and S. Riedel, editors, Proceedings of the 2017 Conference on Empirical Methods in Natural Language Processing, EMNLP 2017, Copenhagen, Denmark, September 9-11, 2017, pages 785–794. Association for Computational Linguistics, 2017. doi: 10.18653/V1/D17-1082. URL https://doi.org/10.18653/v1/d17-1082.

D. Lepikhin, H. Lee, Y. Xu, D. Chen, O. Firat, Y. Huang, M. Krikun, N. Shazeer, and Z. Chen. Gshard: Scaling giant models with conditional computation and automatic sharding. In 9th International Conference on Learning Representations, ICLR 2021. OpenReview.net, 2021. URL https://openreview.net/forum?id=qrwe7XHTmYb.

H. Li, Y. Zhang, F. Koto, Y. Yang, H. Zhao, Y. Gong, N. Duan, and T. Baldwin. CMMLU: Measuring massive multitask language understanding in Chinese. arXiv preprint arXiv:2306.09212, 2023.

W. Li, F. Qi, M. Sun, X. Yi, and J. Zhang. Ccpm: A chinese classical poetry matching dataset, 2021.

X. Liu, X. Lei, S. Wang, Y. Huang, Z. Feng, B. Wen, J. Cheng, P. Ke, Y. Xu, W. L. Tam, X. Zhang, L. Sun, H. Wang, J. Zhang, M. Huang, Y. Dong, and J. Tang. Alignbench: Benchmarking chinese alignment of large language models. CoRR, abs/2311.18743, 2023. doi: 10.48550/ARXIV.2311.18743. URL https://doi.org/10.48550/arXiv.2311.18743.

I. Loshchilov and F. Hutter. Decoupled weight decay regularization. arXiv preprint arXiv:1711.05101, 2017.

Mistral. Cheaper, better, faster, stronger: Continuing to push the frontier of ai and making it accessible to all, 2024. URL https://mistral.ai/news/mixtral-8x22b.

OpenAI. Introducing ChatGPT, 2022. URL https://openai.com/blog/chatgpt.

OpenAI. GPT4 technical report. arXiv preprint arXiv:2303.08774, 2023.

L. Ouyang, J. Wu, X. Jiang, D. Almeida, C. Wainwright, P. Mishkin, C. Zhang, S. Agarwal, K. Slama, A. Ray, et al. Training language models to follow instructions with human feedback. Advances in neural information processing systems, 35:27730–27744, 2022.

B. Peng, J. Quesnelle, H. Fan, and E. Shippole. Yarn: Efficient context window extension of large language models. arXiv preprint arXiv:2309.00071, 2023.

P. Qi, X. Wan, G. Huang, and M. Lin. Zero bubble pipeline parallelism. arXiv preprint arXiv:2401.10241, 2023.

S. Rajbhandari, J. Rasley, O. Ruwase, and Y. He. Zero: Memory optimizations toward training trillion parameter models. In SC20: International Conference for High Performance Computing, Networking, Storage and Analysis, pages 1–16. IEEE, 2020.

C. Riquelme, J. Puigcerver, B. Mustafa, M. Neumann, R. Jenatton, A. S. Pinto, D. Keysers, and N. Houlsby. Scaling vision with sparse mixture of experts. In Advances in Neural Information Processing Systems 34: Annual Conference on Neural Information Processing Systems 2021, NeurIPS 2021, pages 8583–8595, 2021. URL https://proceedings.neurips.cc/paper/2021/hash/48237d9f2dea8c74c2a72126cf63d933-Abstract.html.

K. Sakaguchi, R. L. Bras, C. Bhagavatula, and Y. Choi. Winogrande: An adversarial winograd schema challenge at scale, 2019.

Z. Shao, P. Wang, Q. Zhu, R. Xu, J. Song, M. Zhang, Y. Li, Y. Wu, and D. Guo. Deepseekmath: Pushing the limits of mathematical reasoning in open language models. arXiv preprint arXiv:2402.03300, 2024.

N. Shazeer. Fast transformer decoding: One write-head is all you need. CoRR, abs/1911.02150, 2019. URL http://arxiv.org/abs/1911.02150.

N. Shazeer, A. Mirhoseini, K. Maziarz, A. Davis, Q. V. Le, G. E. Hinton, and J. Dean. Outrageously large neural networks: The sparsely-gated mixture-of-experts layer. In 5th International Conference on Learning Representations, ICLR 2017. OpenReview.net, 2017. URL https://openreview.net/forum?id=B1ckMDqlg.

J. Su, M. Ahmed, Y. Lu, S. Pan, W. Bo, and Y. Liu. Roformer: Enhanced transformer with rotary position embedding. Neurocomputing, 568:127063, 2024.

K. Sun, D. Yu, D. Yu, and C. Cardie. Investigating prior knowledge for challenging chinese machine reading comprehension, 2019.

M. Suzgun, N. Scales, N. Schärli, S. Gehrmann, Y. Tay, H. W. Chung, A. Chowdhery, Q. V. Le, E. H. Chi, D. Zhou, et al. Challenging big-bench tasks and whether chain-of-thought can solve them. arXiv preprint arXiv:2210.09261, 2022.

A. Vaswani, N. Shazeer, N. Parmar, J. Uszkoreit, L. Jones, A. N. Gomez, Ł. Kaiser, and I. Polosukhin. Attention is all you need. Advances in neural information processing systems, 30, 2017.

J. Wei, Y. Tay, R. Bommasani, C. Raffel, B. Zoph, S. Borgeaud, D. Yogatama, M. Bosma, D. Zhou, D. Metzler, et al. Emergent abilities of large language models. arXiv preprint arXiv:2206.07682, 2022.

T. Wei, J. Luan, W. Liu, S. Dong, and B. Wang. Cmath: Can your language model pass chinese elementary school math test?, 2023.

L. Xu, H. Hu, X. Zhang, L. Li, C. Cao, Y. Li, Y. Xu, K. Sun, D. Yu, C. Yu, Y. Tian, Q. Dong, W. Liu, B. Shi, Y. Cui, J. Li, J. Zeng, R. Wang, W. Xie, Y. Li, Y. Patterson, Z. Tian, Y. Zhang, H. Zhou, S. Liu, Z. Zhao, Q. Zhao, C. Yue, X. Zhang, Z. Yang, K. Richardson, and Z. Lan. CLUE: A chinese language understanding evaluation benchmark. In D. Scott, N. Bel, and C. Zong, editors, Proceedings of the 28th International Conference on Computational Linguistics, COLING 2020, Barcelona, Spain (Online), December 8-13, 2020, pages 4762–4772. International Committee on Computational Linguistics, 2020. doi: 10.18653/V1/2020.COLING-MAIN.419. URL https://doi.org/10.18653/v1/2020.coling-main.419.

A. Young, B. Chen, C. Li, C. Huang, G. Zhang, G. Zhang, H. Li, J. Zhu, J. Chen, J. Chang, et al. Yi: Open foundation models by 01. ai. arXiv preprint arXiv:2403.04652, 2024.

R. Zellers, A. Holtzman, Y. Bisk, A. Farhadi, and Y. Choi. HellaSwag: Can a machine really finish your sentence? In A. Korhonen, D. R. Traum, and L. Màrquez, editors, Proceedings of the 57th Conference of the Association for Computational Linguistics, ACL 2019, Florence, Italy, July 28- August 2, 2019, Volume 1: Long Papers, pages 4791–4800. Association for Computational Linguistics, 2019. doi: 10.18653/v1/p19-1472. URL https://doi.org/10.18653/v1/p19-1472.

Y. Zhao, C. Lin, K. Zhu, Z. Ye, L. Chen, S. Zheng, L. Ceze, A. Krishnamurthy, T. Chen, and B. Kasikci. Atom: Low-bit quantization for efficient and accurate LLM serving. CoRR, abs/2310.19102, 2023. URL https://doi.org/10.48550/arXiv.2310.19102.

C. Zheng, M. Huang, and A. Sun. Chid: A large-scale chinese idiom dataset for cloze test. In A. Korhonen, D. R. Traum, and L. Màrquez, editors, Proceedings of the 57th Conference of the Association for Computational Linguistics, ACL 2019, Florence, Italy, July 28- August 2, 2019, Volume 1: Long Papers, pages 778–787. Association for Computational Linguistics, 2019. doi: 10.18653/V1/P19-1075. URL https://doi.org/10.18653/v1/p19-1075.

L. Zheng, W.-L. Chiang, Y. Sheng, S. Zhuang, Z. Wu, Y. Zhuang, Z. Lin, Z. Li, D. Li, E. P. Xing, H. Zhang, J. E. Gonzalez, and I. Stoica. Judging llm-as-a-judge with mt-bench and chatbot arena, 2023.

W. Zhong, R. Cui, Y. Guo, Y. Liang, S. Lu, Y. Wang, A. Saied, W. Chen, and N. Duan. AGIEval: A human-centric benchmark for evaluating foundation models. CoRR, abs/2304.06364, 2023. doi: 10.48550/arXiv.2304.06364. URL https://doi.org/10.48550/arXiv.2304.06364.

C. Zhou, P. Liu, P. Xu, S. Iyer, J. Sun, Y. Mao, X. Ma, A. Efrat, P. Yu, L. Yu, et al. Lima: Less is more for alignment. Advances in Neural Information Processing Systems, 36, 2024.

J. Zhou, T. Lu, S. Mishra, S. Brahma, S. Basu, Y. Luan, D. Zhou, and L. Hou. Instruction-following evaluation for large language models. arXiv preprint arXiv:2311.07911, 2023.