神经语言模型的缩放定律 (Scaling Laws for Neural Language Models)

Jared Kaplan* 约翰霍普金斯大学, OpenAI jaredk@jhu.edu

Sam McCandlish* OpenAI sam@openai.com

Tom Henighan OpenAI henighan@openai.com

Tom B. Brown OpenAI tom@openai.com

Benjamin Chess OpenAI bchess@openai.com

Rewon Child OpenAI rewon@openai.com

Scott Gray OpenAI scott@openai.com

Alec Radford OpenAI alec@openai.com

Jeffrey Wu OpenAI jeffwu@openai.com

Dario Amodei OpenAI damodei@openai.com

摘要

我们研究了语言模型在交叉熵损失(cross-entropy loss)下的经验缩放定律。损失函数随模型大小、数据集大小和训练所用计算量呈幂律(power-law)缩放,某些趋势跨越了七个以上的数量级。其他架构细节(如网络宽度或深度)在很大范围内影响甚微。简单的方程控制了过拟合对模型/数据集大小的依赖性,以及训练速度对模型大小的依赖性。这些关系使我们能够确定固定计算预算下的最优分配。更大的模型具有显著更高的样本效率,因此,最优的计算效率训练涉及在相对适量的数据上训练非常大的模型,并在收敛前显著停止。

同等贡献。

贡献: Jared Kaplan 和 Sam McCandlish 领导了这项研究。Tom Henighan 贡献了 LSTM 实验。Tom Brown、Rewon Child、Scott Gray 和 Alec Radford 开发了优化的 Transformer 实现。Jeff Wu、Benjamin Chess 和 Alec Radford 开发了文本数据集。Dario Amodei 在整个项目过程中提供了指导。

目录

- 引言

- 背景与方法

- 经验结果与基本幂律

- 绘制无限数据极限与过拟合

- 模型大小与训练时间的缩放定律

- 计算预算的最优分配

- 相关工作

- 讨论 附录 A. 幂律总结 B. 计算效率前沿的经验模型 C. 注意事项 D. 补充图表

1. 引言

语言为人工智能的研究提供了一个自然的领域,因为绝大多数推理任务都可以用语言有效地表达和评估,而世界上的文本为通过生成式建模进行无监督学习提供了丰富的数据。深度学习最近在语言建模方面取得了快速进展,最先进的模型 [RNSS18, DCLT18, YDY+19, LOG+19, RSR+19] 在许多特定任务上接近人类水平的性能 [WPN+19],包括创作连贯的多段落提示文本样本 [RWC+19]。

人们可能预期语言建模性能取决于模型架构、神经模型的大小、用于训练它们的计算能力以及该训练过程可用的数据。在这项工作中,我们将实证研究语言建模损失对所有这些因素的依赖性,重点关注 Transformer 架构 [VSP+17, LSP+18]。语言任务性能的高上限和低下限使我们能够研究跨越七个以上数量级的趋势。

在整个过程中,我们将观察到性能作为训练时间、上下文长度、数据集大小、模型大小和计算预算的函数,呈现出精确的幂律缩放。

1.1 摘要

我们对 Transformer 语言模型的关键发现如下:

注:此处我们展示了使用足够小的批次大小时的预测计算量。有关与纯经验数据的比较,请参见图 13。

性能强烈依赖于规模,弱依赖于模型形状: 模型性能最强烈地依赖于规模,规模由三个因素组成:模型参数数量 (不包括嵌入)、数据集大小 以及用于训练的计算量 。在合理范围内,性能对深度与宽度等其他架构超参数的依赖非常微弱。(第 3 节)

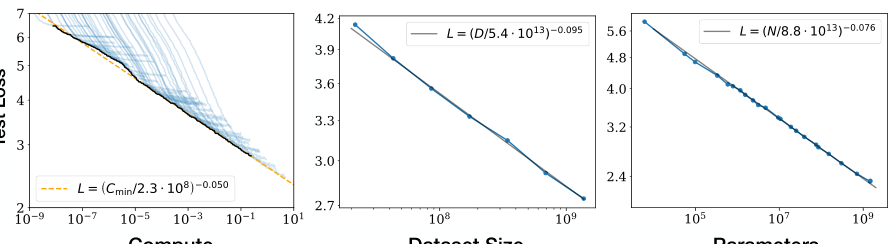

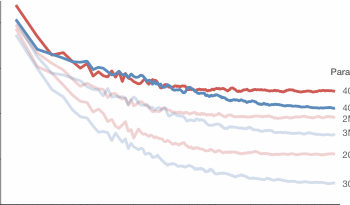

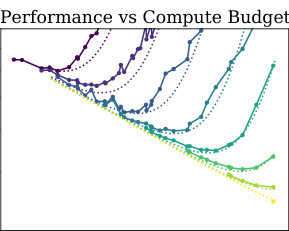

平滑的幂律: 当不受其他两个因素瓶颈限制时,性能与三个规模因素 中的每一个都呈幂律关系,趋势跨越了六个以上的数量级(见图 1)。我们观察到这些趋势在高端没有偏离的迹象,尽管性能在达到零损失之前最终必须趋于平缓。(第 3 节)

过拟合的普遍性: 只要我们协同缩放 和 ,性能就会可预测地提高;但如果固定 或 而增加另一个,则会进入收益递减的区间。性能惩罚可预测地依赖于比率 ,这意味着每次我们将模型大小增加 8 倍,我们只需要增加约 5 倍的数据量即可避免惩罚。(第 4 节)

训练的普遍性: 训练曲线遵循可预测的幂律,其参数大致与模型大小无关。通过外推训练曲线的早期部分,我们可以粗略预测如果训练更长时间将达到的损失。(第 5 节)

迁移随测试性能提高: 当我们在与训练分布不同的文本上评估模型时,结果与训练验证集上的结果强相关,且损失存在大致恒定的偏移——换句话说,迁移到不同的分布会产生恒定的惩罚,但除此之外,其改进大致与训练集上的性能一致。(第 3.2.2 节)

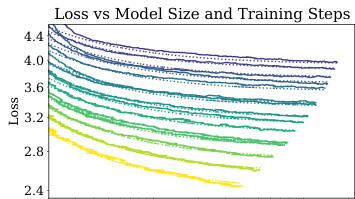

样本效率: 大模型比小模型更具样本效率,以更少的优化步骤(图 2)和更少的数据点(图 4)达到相同的性能水平。

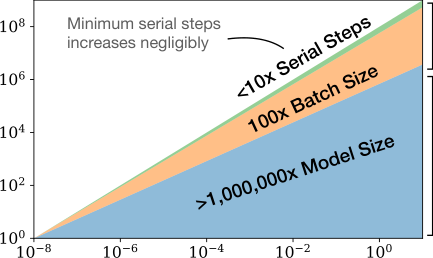

收敛是低效的: 当在固定的计算预算 内工作,但对模型大小 或可用数据 没有其他限制时,我们通过训练非常大的模型并在收敛前显著停止来获得最佳性能(见图 3)。因此,最大计算效率的训练将比基于训练小模型至收敛的预期要高效得多,数据需求随训练计算量的增长非常缓慢,即 。(第 6 节)

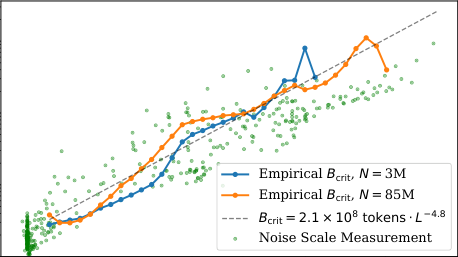

最优批次大小: 训练这些模型的理想批次大小仅大致是损失的幂函数,并且可以通过测量梯度噪声尺度 [MKAT18] 来确定;对于我们能训练的最大模型,在收敛时它大约是 100-200 万个 token。(第 5.1 节)

总而言之,这些结果表明,随着我们适当地扩大模型大小、数据和计算量,语言建模性能会平滑且可预测地提高。我们预计更大的语言模型将比当前模型表现更好,且更具样本效率。

1.2 缩放定律总结

当性能仅受非嵌入参数 、数据集大小 或最优分配的计算预算 限制时,训练用于自回归建模语言的 Transformer 的测试损失可以使用幂律进行预测(见图 1):

-

对于参数数量有限、在足够大的数据集上训练至收敛的模型:

-

对于在有限数据集上训练并进行早停的大模型:

-

当使用有限的计算量、足够大的数据集、最优大小的模型和足够小的批次大小(对计算进行最优利用)进行训练时:

注:我们在固定批次大小训练时也观察到与训练计算量 的经验幂律趋势(图 1),但应使用与 的趋势来进行预测。它们通过方程 (5.5) 相关联。

这些关系在 的八个数量级、 的六个数量级以及 的两个以上数量级范围内成立。它们对模型形状和其他 Transformer 超参数(深度、宽度、自注意力头数)的依赖非常微弱,且具有与 Webtext2 训练集 [RWC+19] 相关的特定数值。幂律 指定了我们扩大 或 时预期的性能改进程度;例如,参数数量加倍会使损失减小 倍。 和 的精确数值取决于词汇表大小和分词,因此没有根本意义。

临界批次大小(决定了数据并行性的速度/效率权衡 [MKAT18])也大致服从损失的幂律:

方程 (1.1) 和 (1.2) 一起表明,随着我们增加模型大小,我们应该根据 次线性地增加数据集大小。事实上,我们发现有一个单一的方程结合了 (1.1) 和 (1.2),它控制了对 和 的同时依赖性,并控制了过拟合程度: 拟合结果如图 4 左侧所示。我们推测这种函数形式也可能参数化其他生成式建模任务的训练对数似然。

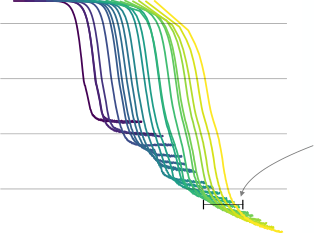

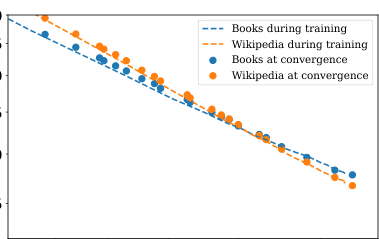

当在无限数据极限下为有限的参数更新步骤 训练给定模型时,经过初始瞬态期后,学习曲线可以被精确拟合(见图 4 右侧): 其中 且 , 是使用方程 (5.4) 估计的最小可能优化步骤(参数更新)。

当在固定计算预算 内训练,但没有其他限制时,方程 (1.6) 导致预测最优模型大小 、最优批次大小 、最优步骤数 和数据集大小 应增长为: 其中 这与经验最优结果 和 紧密匹配。随着计算预算 的增加,它应该主要用于更大的模型,而无需大幅增加训练时间或数据集大小(见图 3)。这也意味着随着模型变大,它们变得越来越具有样本效率。在实践中,研究人员通常训练较小的模型比硬件约束下最大计算效率所需的训练时间更长。最优性能取决于总计算量,呈幂律(见方程 (1.3))。

我们为方程 (1.5) 提供了基本的理论动机,分析了学习曲线拟合及其对训练时间的影响,并按 token 分解了我们的结果。我们还对 LSTM 和循环 Transformer [DGV+18] 进行了简要比较。

1.3 符号

我们使用以下符号:

- – 以 nats 为单位的交叉熵损失。通常它是在上下文中的 token 上平均的,但在某些情况下,我们报告上下文中特定 token 的损失。

- – 模型参数数量,不包括所有词汇表和位置嵌入。

- – 总非嵌入训练计算量的估计,其中 是批次大小, 是训练步骤数(即参数更新)。我们以 PF-days 为单位引用数值,其中 1 PF-day = 次浮点运算。

- – 以 token 为单位的数据集大小。

- – 临界批次大小 [MKAT18],在第 5.1 节中定义和讨论。在临界批次大小下训练提供了时间与计算效率之间大致最优的折衷。

- – 达到给定损失值所需的非嵌入计算量的估计。这是如果模型在远小于临界批次大小的批次大小下训练时所使用的训练计算量。

- – 达到给定损失值所需的最小训练步骤数的估计。这也是如果模型在远大于临界批次大小的批次大小下训练时所使用的训练步骤数。

- – 损失缩放的幂律指数,即 ,其中 可以是 中的任何一个。

2. 背景与方法

我们在 WebText2 上训练语言模型,这是 WebText [RWC+19] 数据集的扩展版本,使用字节对编码 [SHB15] 进行分词,词汇表大小 。我们优化在 1024-token 上下文上平均的自回归对数似然(即交叉熵损失),这也是我们的主要性能指标。我们记录了 WebText2 测试分布以及其他文本分布选择上的损失。我们主要训练仅解码器 [LSP+18, RNSS18] Transformer [VSP+17] 模型,尽管我们也训练了 LSTM 模型和通用 Transformer [DGV+18] 进行比较。

2.1 Transformer 的参数与计算缩放

我们使用超参数 (层数)、(残差流维度)、(中间前馈层维度)、(注意力输出维度)和 (每层注意力头数)来参数化 Transformer 架构。我们包含 个 token 在输入上下文中,除另有说明外,。

我们使用 表示模型大小,定义为非嵌入参数的数量: 其中我们排除了偏置和其他次要项。我们的模型在嵌入矩阵中也有 个参数,并使用 个参数进行位置嵌入,但在讨论“模型大小” 时我们不包括这些;我们将看到这会产生显著更清晰的缩放定律。

评估 Transformer 的前向传递涉及大约 次加乘运算,其中因子 2 来自矩阵乘法中使用的乘加运算。表 1 中包含了更详细的每操作参数和计算计数。

| 操作 | 参数 | 每个 Token 的 FLOPs |

|---|---|---|

| Embed | ||

| Attention: QKV | ||

| Attention: Mask | — | |

| Attention: Project | ||

| Feedforward | ||

| De-embed | — | |

| Total (Non-Embedding) |

表 1: Transformer 模型的参数计数和计算(前向传递)估计。省略了非线性、偏置和层归一化等次要项。

对于 的上下文和模型,每个 token 的上下文相关计算成本是总计算量的一小部分。由于我们主要研究 的模型,因此我们在训练计算量估计中不包括上下文相关项。考虑到反向传递(大约是前向传递计算量的两倍),我们将估计的非嵌入计算量定义为每个训练 token 次浮点运算。

2.2 训练程序

除非另有说明,我们使用 Adam 优化器 [KB14] 训练模型,固定 步,批次大小为 512 个序列,每个序列 1024 个 token。由于内存限制,我们最大的模型(超过 1B 参数)使用 Adafactor [SS18] 进行训练。我们尝试了各种学习率和调度,如附录 D.6 中所讨论。我们发现收敛时的结果在很大程度上与学习率调度无关。除非另有说明,我们数据中包含的所有训练运行都使用了带有 3000 步线性预热后跟余弦衰减至零的学习率调度。

2.3 数据集

我们在 [RWC+19] 中描述的 WebText 数据集的扩展版本上训练我们的模型。原始 WebText 数据集是截至 2017 年 12 月从 Reddit 抓取的获得至少 3 个 karma 的外链。在第二个版本 WebText2 中,我们添加了 2018 年 1 月至 10 月期间的 Reddit 外链,同样要求至少 3 个 karma。Karma 阈值作为人们是否认为链接有趣或有用的启发式方法。新链接的文本使用 Newspaper3k python 库提取。总共,该数据集包含 20.3M 个文档,包含 96 GB 文本和 个单词(由 wc 定义)。然后我们应用 [RWC+19] 中描述的可逆分词器,产生 个 token。我们保留其中的 个 token 作为测试集,并且我们还在类似准备的 Books Corpus [ZKZ+15]、Common Crawl [Fou]、英语维基百科和公开可用的互联网书籍集合的样本上进行测试。

3. 经验结果与基本幂律

为了表征语言模型缩放,我们训练了多种模型,改变了许多因素,包括:

- 模型大小(范围从 768 到 15 亿个非嵌入参数)

- 数据集大小(范围从 2200 万到 230 亿个 token)

- 形状(包括深度、宽度、注意力头数和前馈维度)

- 上下文长度(大多数运行为 1024,尽管我们也尝试了更短的上下文)

- 批次大小(大多数运行为 ,但我们也改变它以测量临界批次大小)

在本节中,我们将展示数据以及经验驱动的拟合,将理论分析推迟到后面的章节。

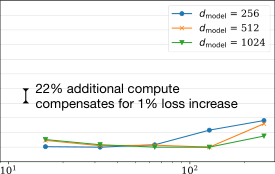

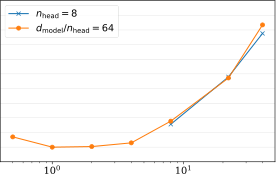

3.1 近似 Transformer 形状和超参数独立性

当我们固定总非嵌入参数计数 时,Transformer 性能对形状参数 和 的依赖非常微弱。为了建立这些结果,我们训练了大小固定但改变单个超参数的模型。这对于 的情况最简单。在改变 时,我们同时改变 ,同时保持 固定。类似地,为了在固定模型大小时改变 ,我们也同时改变了 参数,如表 1 中的参数计数所要求。如果更深的 Transformer 有效地表现为较浅模型的集成(正如 ResNets [VWB16] 所建议的那样),那么 的独立性就会随之而来。结果如图 5 所示。

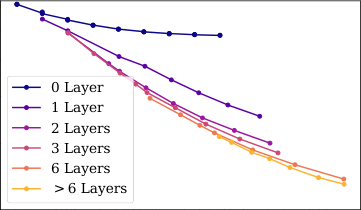

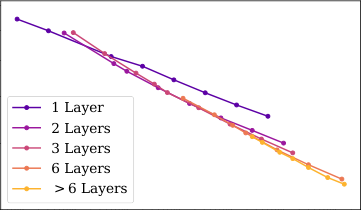

3.2 具有非嵌入参数计数 的性能

在图 6 中,我们展示了各种模型的性能,范围从形状为 的小模型到十亿参数模型,形状范围从 到 。在这里,我们已经在完整的 WebText2 数据集上训练至接近收敛,并且没有观察到过拟合(除了可能对于非常大的模型)。

如图 1 所示,我们发现与非嵌入参数计数 有稳定的趋势,可以拟合到方程 (1.5) 的第一项,因此

要观察这些趋势,研究性能作为 的函数至关重要;如果我们改为使用总参数计数(包括嵌入参数),趋势会有些模糊(见图 6)。这表明嵌入矩阵可以做得更小而不影响性能,正如最近的工作 [LCG+19] 所见。

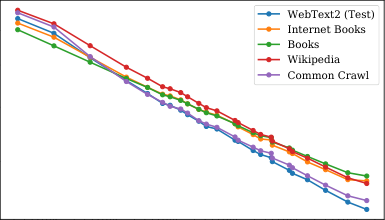

尽管这些模型是在 WebText2 数据集上训练的,但它们在各种其他数据集上的测试损失也是 的幂律,且幂次几乎相同,如图 8 所示。

3.2.1 与 LSTM 和通用 Transformer 的比较

在图 7 中,我们比较了 LSTM 和 Transformer 性能作为非嵌入参数计数 的函数。LSTM 是在相同的数据集和上下文长度下训练的。我们从这些图中看到,LSTM 在上下文中早期出现的 token 上表现得与 Transformer 一样好,但无法匹配 Transformer 在后期 token 上的性能。我们在附录 D.5 中展示了性能与上下文位置之间的幂律关系,其中较大模型越来越大的幂次表明了快速识别模式的能力有所提高。

我们还在附录图 17 中比较了标准 Transformer 与循环 Transformer [DGV+18] 的性能。这些模型重用参数,因此作为 的函数表现略好,代价是每个参数的额外计算量。

3.2.2 数据分布间的泛化

我们还在一组额外的数据分布上测试了我们的模型。这些数据集上的测试损失作为模型大小的函数如图 8 所示;在所有情况下,模型仅在 WebText2 数据集上训练。我们看到这些其他数据分布上的损失随模型大小平滑提高,与 WebText2 上的改进直接平行。我们发现泛化几乎完全取决于分布内验证损失,而不取决于训练持续时间或收敛的接近程度。我们还观察到对模型深度没有依赖性(见附录 D.8)。

3.3 数据集大小和计算量的性能

我们在图 1 中展示了测试损失作为数据集大小 (以 token 为单位)和训练计算量 的函数的经验趋势。

对于 的趋势,我们在 WebText2 数据集的固定子集上训练了一个 的模型。一旦测试损失停止下降,我们就停止训练。我们看到由此产生的测试损失可以用简单的幂律拟合 在数据集大小方面。数据和拟合出现在图 1 中。

训练期间使用的非嵌入计算总量可估计为 ,其中 是批次大小, 是参数更新次数,因子 6 考虑了前向和反向传递。因此,对于给定的 值,我们可以扫描所有具有不同 的模型,以找到在步骤 上具有最佳性能的模型。注意,在这些结果中,批次大小 对所有模型保持固定,这意味着这些经验结果并非真正最优。我们将在后面的章节中使用调整后的 来产生更清晰的趋势。

结果出现在图 1 左侧图上的粗黑线上。它可以拟合为

该图还包括单个学习曲线的图像,以阐明单个模型何时最优。我们将在后面更仔细地研究计算的最优分配。数据强烈表明样本效率随模型大小提高,我们也直接在附录图 19 中进行了说明。

4. 绘制无限数据极限与过拟合

在第 3 节中,我们发现了许多语言建模性能的基本缩放定律。在这里,我们将研究在 个 token 的数据集上训练的 大小模型的性能,同时改变 和 。我们将经验证明最优训练的测试损失符合方程 (1.5) 的缩放定律。这为我们在保持过拟合受控的同时训练更大模型所需的数据量提供了指导。

4.1 提出的 方程

我们选择了参数化 (1.5)(为方便起见在此重复): 使用三个原则:

- 词汇表大小或分词的变化预计会按整体因子重新缩放损失。 的参数化(以及所有损失模型)必须自然地允许这种重新缩放。

- 固定 并令 ,总损失应接近 。相反,固定 并令 ,损失必须接近 。

- 在 时应是解析的,因此它具有 的整数幂级数展开。该原则的理论支持明显弱于前两个。

我们对 的选择满足第一个要求,因为我们可以随着词汇表的变化重新缩放 。这也意味着 的值没有根本意义。

由于我们在测试损失停止提高时尽早停止训练并以相同方式优化所有模型,我们预期更大的模型应该总是比更小的模型表现更好。但对于固定的有限 ,我们也不预期任何模型能够接近最佳可能的损失(即文本的熵)。类似地,具有固定大小的模型将受到容量限制。这些考虑因素激发了我们的第二个原则。注意,在无限 下的 和在无限 下的 的知识完全确定了 中的所有参数。

第三个原则更具推测性。有一个简单且普遍的原因,人们可能预期过拟合在非常大的 时按 缩放。过拟合应该与数据集的方差或信噪比有关 [AS17],这按 缩放。这种预期应该适用于任何平滑的损失函数,因为我们预期能够围绕 极限展开损失。然而,该论点假设 校正主导了其他方差来源,例如有限的批次大小和优化效率的其他限制。没有经验确认,我们不会对其适用性非常有信心。

我们的第三个原则解释了 和 在方程 (1.5) 中角色的不对称性。非常相似的对称表达式是可能的,但它们不会具有带整数幂的 展开,并且需要引入额外的参数。

无论如何,我们将看到我们的 方程很好地拟合了数据,这是我们 假设的最重要理由。

4.2 结果

我们用 10% 的 dropout 对所有模型进行正则化,并通过跟踪测试损失并在其不再下降时停止。结果显示在图 9 中,包括对方程 (1.5) 中四个参数 的拟合:

| 参数 | ||||

|---|---|---|---|---|

| 值 | 0.076 | 0.103 |

表 2: 对 的拟合

我们获得了极好的拟合,除了数据集减少了 1024 倍至约 个 token 的运行。对于如此小的数据集,一个 epoch 仅包含 40 次参数更新。也许如此微小的数据集代表了语言建模的不同区间,因为过拟合在训练早期就发生了(见图 16)。还要注意,参数与第 3 节中获得的参数略有不同,因为这里我们拟合的是完整的 而不仅仅是 或 。

为了绘制无限数据极限的边界,我们可以直接研究过拟合的程度。对于除最大模型之外的所有模型,在使用完整的 22B token WebText2 数据集训练时,我们没有看到过拟合的迹象,因此我们可以将其视为 的代表。因此我们可以通过定义 并将其作为 的函数进行研究,从而将有限 与无限数据极限进行比较。事实上,我们经验性地看到 仅取决于 和 的特定组合,如图 16 所示。这遵循方程 (1.5) 的缩放定律,这意味着 注意,在大的 时,该公式也具有 幂次的级数展开。

我们估计不同随机种子下损失的变化约为 0.02,这意味着为了在训练至收敛阈值内时避免过拟合,我们需要 利用此关系,小于 参数的模型可以在 22B token 的 WebText2 数据集上以最小的过拟合进行训练,但我们最大的模型将遇到一些轻微的过拟合。更一般地,该关系表明数据集大小可以随模型大小次线性增长,同时避免过拟合。然而,请注意,这通常不代表最大计算效率的训练。我们还应强调,在改变数据集和模型大小时,我们并未优化正则化(例如 dropout 概率)。

5. 模型大小与训练时间的缩放定律

在本节中,我们将证明一个简单的缩放定律为损失作为模型大小 和训练时间的函数提供了很好的描述。首先,我们将解释如何使用 [MKAT18] 的结果来定义一个通用的训练步数 ,它解释了我们大多数模型并非在最优批次大小下训练的事实。然后,我们将证明我们可以使用方程 (1.6) 拟合损失对模型大小和训练时间的依赖性。稍后,我们将使用这些结果来预测训练计算量在模型大小和训练时间之间的最优分配,并确认该预测。

5.1 针对 的训练调整

[MKAT18](参见 [SLA+18, ZLN+19])开发了一种简单的训练批次大小依赖性的经验理论。有人认为存在一个训练的临界批次大小 ;对于 ,批次大小可以在计算效率极小退化的情况下增加,而对于 ,增加 会导致收益递减。还有人认为梯度噪声尺度提供了一个简单的预测,用于 ,且除了通过已达到的损失值外,它并不直接依赖于模型大小。这些结果可用于预测训练时间和计算量将如何随批次大小变化。为了尽可能有效地利用训练时间和计算量,最好以 的批次大小进行训练。以 训练可最小化训练步数,而以 训练可最小化计算量的使用。

更具体地说,已证明对于各种神经网络任务,训练步数 和处理的数据示例数 满足简单关系 当训练至损失 的任何固定值时。这里 是达到 所需的最小步数,而 是必须处理的最小数据示例数。

我们在附录图 18 中展示了 Transformer 的关系 (5.1)。该关系定义了临界批次大小 它是损失目标值的函数。在临界批次大小下训练可实现大致最优的时间/计算折衷,需要 训练步数并处理 个数据示例。

在图 10 中,我们绘制了临界批次大小和梯度噪声尺度作为两个不同模型训练损失的函数。我们看到 与模型大小无关,仅取决于损失 。因此,[MKAT18] 的预测继续适用于 Transformer 语言模型。临界批次大小可以用损失的幂律拟合 其中 且 。

我们为 选择了这种参数化,因为随着损失接近其最小值 ,梯度噪声尺度预计会发散,并且我们预期 会跟踪该噪声尺度。我们不知道 ,因为我们没有看到我们的模型正在接近它的迹象,但 ,因为自然语言的熵是非零的。由于 显然远小于我们已经达到的 值,我们使用了 随 发散的参数化。

我们将使用 来估计在批次大小 token 下训练时的训练步数 与在 下训练时的训练步数之间的关系。这很简单 对于损失的任何给定目标值 。这也定义了如果我们在 下训练,用大小为 的模型训练至 所需计算量的临界值。这是 其中 估计了在批次大小 下使用的(非嵌入)计算量。

5.2 的结果以及模型大小和计算量的性能

现在我们将使用方程 (5.4) 中定义的 来获得损失对无限数据极限下模型大小和训练时间依赖性的简单且通用的拟合。我们将使用方程 (1.6) 拟合稳定的、Adam 优化的训练运行,为方便起见在此重复: 对于损失。我们包括学习率调度预热期之后的所有训练步数,并找到具有以下参数的数据拟合:

| 参数 | ||||

|---|---|---|---|---|

| 值 | 0.077 | 0.76 |

表 3: 对 的拟合

利用这些参数,我们获得了图 4 中的学习曲线拟合。虽然拟合并不完美,但考虑到方程 (5.6) 的简单性,我们认为它们非常令人信服。

数据和拟合可以以一种不同且更有趣的方式可视化,如图 11 所示。在那里,我们研究了测试损失作为模型大小的函数,同时固定训练中使用的总非嵌入计算量 或步数 。对于拟合,我们使用方程 (5.5) 和 (5.4) 以及上述参数和方程 (5.6)。

损失对 的幂律依赖性反映了优化器动力学和损失景观之间的相互作用。由于拟合在训练后期最好,此时损失可能近似为二次型,因此幂律应该提供关于损失 Hessian 谱的信息。它的普遍性表明 Hessian 特征值密度大致与模型大小无关。

5.3 早停步数的下界

的结果可用于推导数据受限时应发生早停的步数的下界(和粗略估计)。它的动机是这样的想法:对于给定的模型,有限和无限 的学习曲线在达到 之前将非常相似。因此,过拟合应该与仅仅在 结束训练的校正成正比。这将低估 ,因为实际上当我们有有限的 时,测试损失会下降得更慢,因此我们将需要更多的训练步数才能达到有限 下的最优测试损失。这种推理导致了不等式 其中 是收敛损失,用无限可用数据评估。该不等式及其与经验数据的比较显示在附录图 16 中。在该图中, 和 的值是经验性的(尽管 经过调整以模拟 下的训练),而 是根据在 下评估的 拟合计算得出的。

6. 计算预算的最优分配

我们在图 1 右上角展示了性能作为训练期间所用计算量的函数的经验趋势。然而,该结果涉及在固定批次大小 下进行训练,而我们知道

事实上,我们可以通过以第 5.1 节中讨论的批次大小 进行训练来更有效地训练。损失的大值和小值本可以分别通过更少的样本或更少的步数实现,通过标准化到临界批次大小来纠正这种低效性,从而产生更清晰、更可预测的趋势。

在本节中,我们将针对这一疏忽进行调整。更重要的是,我们将使用第 5 节的结果来确定模型大小 与训练期间处理的数据量(即 )之间的最优计算分配。我们将通过使用 的方程,从经验和理论上确定这种分配,并将证明这些方法是一致的。

6.1 最优性能与分配

让我们首先研究损失作为方程 (5.5) 中最优分配计算量的函数。结果绘制在图 13 中,并附有幂律拟合。我们看到,与图 1 的计算量图相比,新的 拟合有所改进。

给定 ,自然会问在给定训练计算量下提供最小损失的最优模型大小 是多少。最优模型大小如图 14 所示。我们观察到

可以用幂律很好地拟合

在图 12 中,我们展示了次优大小模型训练的效果(见附录 B.4)。 根据定义 ,因此我们可以使用 来提取进一步的结果。特别是,由于先前的拟合显示 且 ,我们可以得出结论 。这导致我们得出结论,最优步数只会随计算量增长得非常缓慢,即 这与图 14 中的经验结果相匹配。事实上,测得的指数足够小,以至于我们的结果甚至可能与零指数一致。

因此,我们得出结论,随着我们以最优计算分配扩大语言建模,我们应该主要增加模型大小 ,同时通过 扩大批次大小,而串行步数增加可忽略不计。由于计算效率高的训练使用相对较少的优化步骤,因此可能需要额外的工作来加速早期训练动力学。

6.2 来自 的预测

的结果和分配可以从第 5 节中获得的 方程中预测。给定我们的 方程,我们可以代入 ,然后在固定训练计算量的情况下找到损失作为 的函数的最小值。我们在附录 B 中详细执行了此过程,并在其中提供了一些额外的预测。

对于作为训练计算量函数的损失,我们预测 其中 与图 13 的指数非常一致。我们还预测 这也与图 14 的缩放比例在几个百分点内相匹配。我们的缩放定律为语言建模的性能提供了一个预测框架。

6.3 矛盾与猜想

我们观察到在大的计算量、数据或模型大小值下,直线幂律趋势没有偏离的迹象。尽管如此,我们的趋势最终必须趋于平缓,因为自然语言具有非零熵。

事实上,本节中描述的计算效率训练趋势已经包含了一个明显的矛盾。在比此处记录的规模大几个数量级的规模上,由 缩放定律预测的性能下降到低于给定计算量下训练数据增长缓慢所应有的可能水平。这意味着我们的缩放定律必须在此点之前失效,但我们推测交点具有更深层的含义:它提供了 Transformer 语言模型达到最大性能点的估计。

由于计算效率训练使用的数据量随计算预算增长缓慢,由 预测的性能最终会触及由 幂律设定的下界(见图 15)。让我们更详细地计算一下。

为了保持过拟合受控,第 4 节的结果意味着我们应该将数据集大小缩放为 其中我们使用了图 14 中的计算效率 。

让我们将其与计算效率训练的数据需求进行比较。如果我们以临界批次大小(即 )进行训练,并且在训练期间从不重复使用数据,我们发现数据使用量随计算量增长为 这是数据集大小随计算量有效增长的最大速率,因为它意味着我们只进行单 epoch 训练。但它使数据集的增长比方程 (6.6) 中要慢得多。这似乎意味着计算效率训练最终会遇到过拟合问题,即使训练过程从不重复使用任何数据!

根据图 1,我们预期当我们受到数据集大小(即过拟合)的瓶颈限制时,损失应按 缩放。这意味着一旦我们受到数据限制,损失将随计算量按 缩放。再一次,我们遇到了矛盾,因为这将最终与我们从图 13 中对 的预测相交,我们在那里发现缩放 。

和 的交点发生在 尽管数值高度不确定,根据幂律拟合的指数精确值,在任一方向上变化一个数量级。最明显的解释是我们的缩放定律在达到这一点时或之前失效,这在计算量和模型大小方面仍然相差许多数量级。

人们可能还会推测这个交点具有更深层的含义。如果我们不能在不产生质上不同的数据需求的情况下将模型大小增加到 以上,也许这意味着一旦我们达到 和 ,我们就已经提取了自然语言数据中可用的所有可靠信息。在这种解释中, 将为自然语言的每 token 熵提供一个粗略估计。在这种情况下,我们预期损失趋势会在 处或之前趋于平缓。

我们可以通过考虑带有添加噪声的训练数据集版本,来猜测 在趋于平缓时的函数形式。例如,我们可以将随机 token 字符串附加到模型看到的每个上下文中,以通过恒定的加性因子人为地提高损失。那么,距离噪声底限 将是一个更有意义的性能指标,即使该距离的微小减少也可能代表定性性能的显著提升。由于人工噪声会同样影响我们所有的趋势,6.8 的临界点将不会改变(除了 的绝对值),并且即使它发生在趋于平缓之后,也可能是有意义的。

7. 相关工作

幂律可以来自各种各样的来源 [THK18]。密度估计 [Was06] 和随机森林模型 [Bia12] 中随模型和数据集大小的幂律缩放可能与我们的结果相关。这些模型表明幂律指数可能对数据中相关特征数量的倒数有一个非常粗略的解释。

一些早期 [BB01, Goo01] 的工作发现了性能与数据集大小之间的幂律缩放。最近的工作 [HNA+17, HAD19] 也研究了模型大小与数据大小之间的缩放;他们的工作可能是文献中与我们最接近的。然而,请注意,[HNA+17] 发现了数据集大小随模型大小的超线性缩放,而我们发现了次线性缩放。我们在计算最优分配方面的发现与 [Kom19] 之间存在一些相似之处,包括幂律学习曲线。EfficientNets [TL19] 也似乎服从准确率与模型大小之间的近似幂律关系。非常近期的工作 [RRBS19b] 研究了随数据集大小和模型大小的缩放,并拟合了类似于我们的 ansatz。

EfficientNet [TL19] 主张指数级缩放深度和宽度(具有不同的系数)以获得图像模型的最优性能,从而导致宽度作为深度函数的幂律缩放。我们发现对于语言模型,在扩大规模时,该幂次应该大致为 1(因为宽度/深度应该保持固定)。但更重要的是,我们发现精确的架构超参数与语言模型的整体规模相比并不重要。在 [VWB16] 中,有人认为深度模型可以作为较浅模型的集成发挥作用,这可能解释了这一发现。早期的工作 [ZK16] 比较了宽度和深度,发现宽 ResNets 在图像分类上可以优于深 ResNets。一些研究固定了每个数据示例的计算量,这往往与模型参数数量成比例缩放,而我们研究了随模型大小和训练计算量数量的缩放。

各种工作 [AS17, BHMM18] 研究了高度过参数化模型中的泛化,当模型大小达到数据集大小(这可能需要训练比典型实践多许多数量级,特别是没有使用早停)时,发现了“干扰转变” [GJS+19]。我们没有观察到这种转变,并发现必要的训练数据随模型大小次线性缩放。模型大小的展开,特别是在大宽度下 [JGH18, LXS+19],可能为思考我们的一些缩放关系提供了一个有用的框架。我们在优化方面的结果,例如学习曲线的形状,很可能可以使用噪声二次模型来解释,该模型可以在现实设置中提供相当准确的预测 [ZLN+19]。使这种联系定量化将需要表征 Hessian 谱 [Pap18, GKX19, GARD18]。

8. 讨论

我们观察到了语言模型对数似然损失随非嵌入参数计数 、数据集大小 和优化训练计算量 的一致缩放,如方程 (1.5) 和 (1.6) 所封装。相反,我们发现对许多架构和优化超参数的依赖非常微弱。由于随 的缩放是幂律,因此随着规模的增加存在收益递减。

我们能够精确地模拟损失对 和 的依赖性,或者在这些参数同时变化时对 和 的依赖性。我们使用这些关系推导了训练大语言模型时的计算缩放、过拟合程度、早停步数和数据需求。因此,我们的缩放关系超越了单纯的观察,提供了一个预测框架。人们可以将这些关系解释为理想气体定律的类似物,它以一种通用的方式关联气体的宏观性质,独立于其微观成分的大多数细节。

自然地推测缩放关系将适用于具有最大似然损失的其他生成式建模任务,也许也适用于其他设置。为此,在其他领域(如图像、音频和视频模型,也许还有随机网络蒸馏)测试这些关系将是很有趣的。在这一点上,我们不知道我们的哪些结果取决于自然语言数据的结构,哪些是通用的。找到一个可以推导出缩放关系的理论框架也将是令人兴奋的:我们所观察到的“热力学”背后的“统计力学”。这样的理论可能使推导其他更精确的预测成为可能,并提供对缩放定律局限性的系统理解。

在自然语言领域,研究损失的持续改进是否转化为相关语言任务的改进将非常重要。平滑的定量变化可以掩盖重大的定性改进:“多即不同”。例如,经济的平滑总量增长并没有提供支撑它的特定技术发展的迹象。同样,语言模型损失的平滑改进可能掩盖了看似定性的能力变化。

我们的结果强烈表明,更大的模型将继续表现更好,并且也将比以前所认识到的更具样本效率。大模型可能比大数据更重要。在这种背景下,进一步研究模型并行化是必要的。深度模型可以使用流水线 [HCC+18] 进行训练,它在设备之间深度拆分参数,但最终随着更多设备的使用需要增加批次大小。另一方面,宽网络更易于并行化 [SCP+18],因为大层可以在多个工作节点之间拆分,且串行依赖性更小。稀疏性 [CGRS19, GRK17] 或分支(例如 [KSH12])可能通过增加模型并行化允许更快地训练大网络。并且使用像 [WRH17, WYL19] 这样的方法,在训练时增长网络,可能在整个训练运行中保持在计算效率前沿。

致谢

我们要感谢 Shan Carter、Paul Christiano、Jack Clark、Ajeya Cotra、Ethan Dyer、Jason Eisner、Danny Hernandez、Jacob Hilton、Brice Menard、Chris Olah 和 Ilya Sutskever 的讨论以及对本工作草稿的反馈。